Infineon

Hochwertige Audiosignalerfassung per MEMS-Mikrofon

Fortsetzung des Artikels von Teil 1

Auf den Signal/Rauschabstand kommt's an

Optimierte Spracherkennung

Für Systeme, die mit Algorithmen arbeiten, werden Tonsignale anders erfasst, als sie vom menschlichen Ohr wahrgenommen werden. Daher sind auch die Zielvorgaben hinsichtlich der Tonqualität unterschiedlich. Das Signal muss nicht unbedingt natürlich klingen, solange es für die verwendeten Algorithmen optimiert ist. Unabhängig vom Anwendungsfall ist es wichtig, dass das Signal frei von Störungen, Verzerrungen und Rauschen bleibt.

Unter automatischer Spracherkennung versteht man den Prozess, durch den Sprachsignale automatisch in geschriebenen Text übertragen werden. Die Genauigkeit liegt derzeit bei etwa 95 Prozent und kommt bereits sehr nahe an das menschliche Niveau heran. Dieser Wert wurde bisher aber nur in Labors mit sehr günstigen Umgebungsbedingungen erreicht.

Bei der Entwicklung einer Sprachsteuerung sollte sich der Grundgedanke stets darauf konzentrieren, dass sie für den Endnutzer zuverlässig und einfach zu bedienen ist. Um das zu erreichen, müssen Systementwickler die tatsächliche Anwendung in der Praxis berücksichtigen, beispielsweise die wahrscheinliche Entfernung des Benutzers vom Mikrofon und die zu erwartende Lautstärke von Hintergrundgeräuschen. Nur dann ist es möglich, das System so auszulegen, dass es bestmögliche Leistungen erzielt.

In der Praxis hat die Sprachsteuerung, insbesondere wenn sich der Sprecher nicht in unmittelbarer Nähe befindet, meist mit erheblichen Schwierigkeiten in Bezug auf die Akustik zu kämpfen, zum Beispiel mit Hintergrundgeräuschen, Nachhall, Echounterdrückung und der Mikrofonposition. Daher reicht es nicht, einfach nur eine gute Spracherkennungs-Software zu haben. Jeder Baustein des Systems sollte bestmögliche Leistungen liefern, damit keine Qualitätseinbußen auftreten. Das Mikrofon hat die Aufgabe, das Spracherkennungssystem mit dem bestmöglichen Eingangssignal zu versorgen. Ein qualitativ hochwertiges Eingangssignal hilft, den sprachlichen Inhalt des eingehenden Geräusches zu analysieren. Zu den entscheidenden Parametern gehören dabei das Rauschen, die Verzerrung, der Frequenzgang und die Phase.

Jobangebote+ passend zum Thema

In Umgebungen mit starken Störgeräuschen kann die Spracherkennung erheblich verbessert werden, wenn das verwendete Mikrofon eine hohe Linearität, das heißt möglichst wenige Verzerrungen aufweist. Ein hoher AOP trägt dazu bei, Verzerrungen gering zu halten und die Unterdrückung von Störgeräuschen und Echos zu verbessern. Manchmal ist das Sprachsignal selbst nicht laut genug, und es sind andere Geräusche vorhanden, die Störungen verursachen. Das ist beispielsweise der Fall, wenn ein Sprecher nahe am Mikrofon eines sprachgesteuerten Endgerätes steht oder wenn digitale Sprachassistenten laute Musik oder gesprochene Informationen wiedergeben.

Möglichst großer Signal-Rausch-Abstand

Je größer der Abstand zur Quelle des Sprachsignals ist, desto geringer ist der Signal-Rausch-Abstand des Signals, das in den Algorithmus eingespeist wird. Daher sollte das Signal-Rausch-Verhältnis des Mikrofons höher sein, wenn der vorgesehene Erfassungsabstand größer ist.

Die Erfassung von Audio- und Videosignalen kann ebenso wie die Qualität eines Gesprächs von Mensch zu Mensch verbessert werden, wenn unerwünschte Geräusche aus dem Signal ausgeblendet werden. Ziel ist es, den Signal-Rauschabstand zu vergrößern, also in diesem Fall das Verhältnis zwischen dem erwünschten Tonsignal und unerwünschten Umgebungsgeräuschen (Rauschen). Rauschunterdrückung und Richtcharakteristik lassen sich durch Verwendung mehrerer Mikrofone in Verbindung mit geeigneten Algorithmen erreichen.

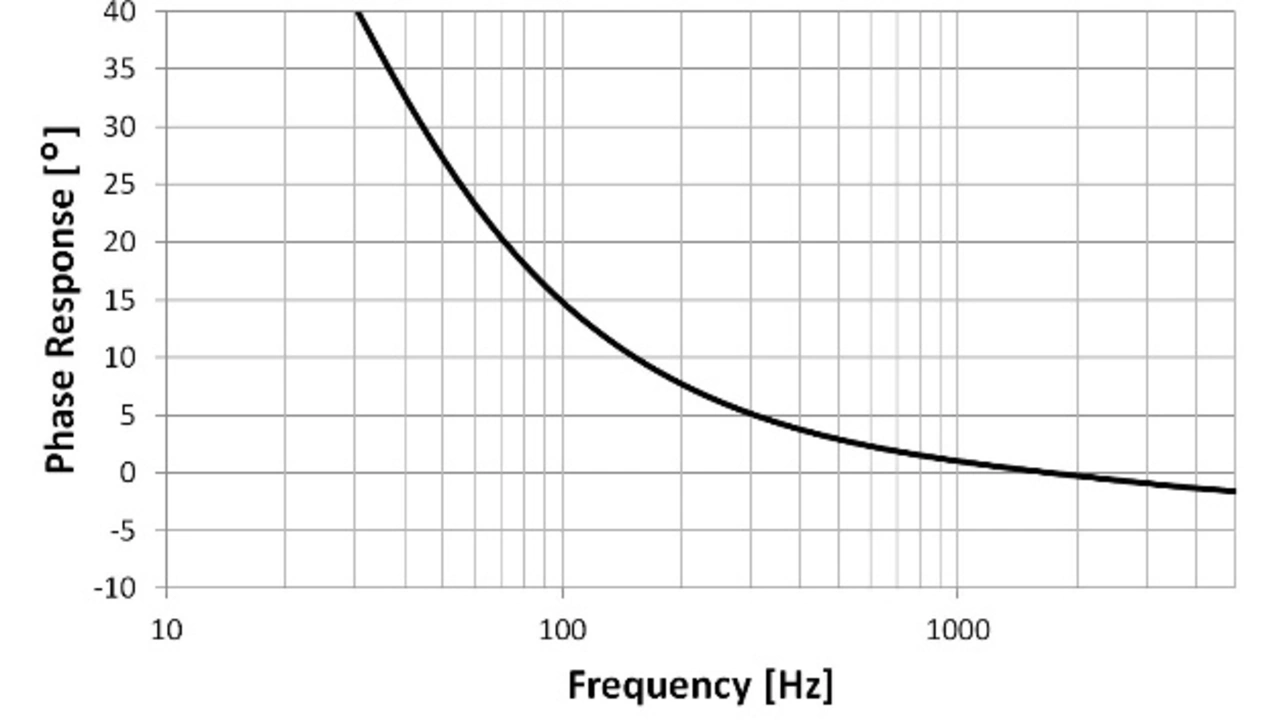

Richtmikrofonsysteme, die beispielsweise mit Beamforming-Algorithmen arbeiten, können die Empfindlichkeit der Mikrofone in der gewünschten Richtung erhöhen und die erwünschten Schallquellen hervorheben. Eine ausgefeilte Methode zur Unterdrückung von Störgeräuschen sind „Blind Source Separation“-Algorithmen. Diese ermöglichen die Unterdrückung von Störgeräuschen unabhängig von der Richtung, von der Entfernung und vom Ort der Entstehung. Alle diese Verfahren zur Unterdrückung von Störgeräuschen profitieren von der Genauigkeit und Qualität des Signals, das sie empfangen. Das Mikrofon sollte daher einen möglichst großen Signal-Rauschabstand, eine geringe Verzerrung, einen linearen Frequenzgang (der auch den Phasengang verbessert) und eine geringe Gruppenlaufzeit aufweisen.

- Hochwertige Audiosignalerfassung per MEMS-Mikrofon

- Auf den Signal/Rauschabstand kommt's an

- Funktionen und Kennwerte des IM69D130