Moderne ADAS-Architekturen

Automotive-Kommunikationsprotokolle im Überblick

Moderne Fahrzeuge sind auf für Automotive-Anwendungen geeignete Kommunikationstechnologien angewiesen, die dank hoher Übertragungsraten und -distanzen sowohl die Aspekte Sicherheit als auch Autonomie vorantreiben. Doch welche Technik ist die beste?

Elektrische Bauteile hielten erstmals im Jahr 1915 Einzug in die Kraftfahrzeuge, als die Firma Ford ihr Model T mit elektrischer Beleuchtung und einer elektrischen Hupe ausstattete. Seit dieser Zeit ist die Abhängigkeit der Automobile von elektrischen und elektronischen Systemen stetig gewachsen. Die ersten Systeme waren dabei noch eher lokal und eigenständig. Der Schalter für die Beleuchtung etwa war direkt mit der Batterie verbunden, oder ein Lautsprecher wurde durch ein Relais geschaltet.

Gemeinsam mit den Systemarchitekturen haben sich auch die Mechanismen weiterentwickelt, mit deren Hilfe die verschiedenen Subsysteme im Auto miteinander kommunizieren. Ein Beispiel ist die Lichtautomatik, die bei einsetzender Dämmerung selbsttätig die Fahrzeugbeleuchtung einschaltet. Zusätzlich könnte dieses System die Helligkeit aller Displays verändern, den Weißabgleich sämtlicher Kameras anpassen, den Sicherheitsabstand beim Fahren vergrößern und den Bremsmodulen eine höhere Priorität einräumen – alles mit dem Ziel, die Fahrsicherheit zu verbessern.

Beim automatisierten und autonomen Fahren kommt es darauf an, dass die Kommunikation sicher, geschützt und möglichst in Echtzeit erfolgt. Verschärft wird diese Herausforderung durch die Tatsache, dass der Umfang der gesendeten und empfangenen Daten nicht mehr einige hundert Kilobit pro Sekunde (kbit/s) beträgt, sondern im zweistelligen Gbit/s-Bereich liegt.

Vier Kommunikationsprotokolle für Automotive-Anwendungen stehen nachfolgend im Fokus. Neben Ethernet sind dies die FPD-Link-Technik (Flat Panel Display), ein proprietäres SerDes-Protokoll (Serializer/Deserializer) für Automotive-Anwendungen, sowie der CAN- (Controller Area Network) und der PCIe-Bus (Peripheral Component Interconnect Express). Dabei wird nicht nur auf die wichtigsten Besonderheiten der einzelnen Lösungen eingegangen, sondern anhand von Beispielen auch gezeigt, wie diese Technologien moderne Fahrassistenzsysteme unterstützen.

Ethernet im Auto

Ethernet, eine der verbreitetsten Highspeed-Schnittstellen im privaten und gewerblichen Bereich, entwickelt sich auch in Fahrzeugen zum vorherrschenden Kommunikationsprotokoll. In einigen Fahrzeugen wird Ethernet bereits zur Übertragung einer Vielzahl von Highspeed-Daten verwendet. Unter anderem bei Radar- und Lidar-Modulen kommt Single-Pair-Ethernet zum Einsatz. Diese Technik basiert auf dem Ethernet-Standard, jedoch erfolgt die Datenübertragung über ein einziges verdrilltes Leiterpaar, was sowohl das Gewicht als auch die Kosten der im Fahrzeug verbauten Kabel verringert.

Ethernet ist ein paketorientiertes Protokoll. Die von einem Netzwerkknoten zum anderen zu übertragenden Daten werden also in Pakete verpackt. Ähnlich wie der CAN-Bus ist Ethernet bidirektional, und die auf einer Verbindung erzielbare Übertragungsrate wird umso geringer, je mehr Knoten an das System angeschlossen sind. Bei Single-Pair-Ethernet ist die Übertragungsrate jeder Verbindung auf einen bestimmten Wert (10 Mbit/s, 100 Mbit/s oder 1 Gbit/s) beschränkt, und es gibt keine dynamischen Änderungen der Übertragungsrate auf dieser Verbindung.

Dennoch können Daten mit Single-Pair-Ethernet bis zu tausendmal schneller übertragen werden als per CAN. Durch den Umstieg auf Single-Pair-Ethernet lässt sich also die Übertragungsrate gegenüber CAN optimieren. Da aber die Kosten pro Knoten bei Ethernet höher sind, dürfte CAN durch Ethernet nicht verdrängt, sondern eher ergänzt werden.

In bestimmten Fahrzeugen kommt Single-Pair-Ethernet derzeit in datenintensiven Anwendungen, beispielsweise Rückfahrkamera oder Radar, zum Einsatz. Mit den Bausteinen DP83TC812S-Q1 und DP83TG720S-Q1 bietet Texas Instruments zwei Physical-Layer-Chips (PHY) für Single-Pair-Ethernet an, die gemäß AEC-Q100 (Grade 1 und 2) zertifiziert sind und einen Loopback-Prüfmodus enthalten, um die Systemdiagnose gemäß IEEE 802.3bw und 802.3bp zu unterstützen.

Damit Videodaten per Ethernet übertragen werden können, ist es auch bei nur einem Videokanal erforderlich, das Videosignal an seiner Quelle zu komprimieren und an seinem Ziel zu dekomprimieren, denn sonst würde die Maximalbandbreite von Ethernet überschritten. Im Gegensatz dazu erlaubt FPD-Link die Übertragung unkomprimierter Videodaten.

Damit die Übertragung per Ethernet in Betracht kommt, benötigen Anwendungen wie etwa Rückfahrkameras einen relativ leistungsstarken Prozessor zum Komprimieren der Bilddaten. Dies aber führt dazu, dass die Kameras größer und teurer werden und nicht zuletzt mehr Strom benötigen als Lösungen, die ohne größere Bildkompression auskommen. Als weiterer Nachteil kommt hinzu, dass die Kompression und Dekompression des Videosignals zwangsläufig die Latenz der Übertragung erhöht.

Werden mehrere Kameras oder andere Videoquellen an dasselbe Ethernet-Netzwerk angeschlossen, muss zudem zwischen dem Kompressionsverhältnis, das Einfluss auf die Bildqualität hat, und der Anzahl der unterstützten Videokanäle abgewogen werden.

Abmildern lässt sich diese Einschränkung, indem man das betreffende Fahrzeug mit mehreren, hierarchisch gegliederten Netzwerken ausstattet. Zum Beispiel ist es denkbar, ein Netzwerk ausschließlich für Motorsteuerung und Diagnose zu nutzen, ein zweites für das Rear Seat Entertainment und ein drittes für Fahrassistenzfunktionen wie etwa sichtverbessernde Kameras.

Single-Pair-Ethernet bietet mehr Übertragungskapazität als CAN, wenn es um die Übertragung beispielsweise von Radar- oder Lidar-Daten geht. Dies geschieht auf Kosten höherer Komplexität, reicht aber für Anwendungen mit besonders großem Bandbreitenbedarf, zum Beispiel Video, noch nicht aus.

FPD-Link

FPD-Link ist eine proprietäre SerDes-Technologie für Automotive-Anwendungen, die eigens für die Echtzeitübertragung unkomprimierter, breitbandiger Daten entwickelt wurde. Unter anderem wurde sie für den Transport von Videodaten innerhalb von Fahrzeugen konzipiert, um eine bessere Datenanalyse und -verarbeitung in ADAS-Anwendungen zu ermöglichen. Unter anderem eignet sich FPD-Link, um unkomprimierte Videodaten an ein Display zu übermitteln, während über den Rückkanal Informationen von einer nach außen gerichteten Kamera an den Prozessor übertragen werden.

Der Prozessor wiederum nutzt die Bildverarbeitung und entsprechende Algorithmen, um Anweisungen an die Fahrzeugsysteme oder an die Person am Steuer zu schicken (zum Beispiel für ein automatisches Bremsmanöver). Als Übertragungsmedium für FPD-Link dient ein Twisted-Pair- oder Koaxialkabel, wobei jeweils separat verkabelt wird.

Wird also eine Rückfahrkamera per FPD-Link angeschlossen, führt ein Kabel von der Kamera zum Prozessor und ein weiteres vom Prozessor zum Display in der Armaturentafel. Der wichtigste Vorteil, den FPD-Link in dieser Anwendung bietet, besteht darin, dass Kamera und Display wegen des Wegfalls der Kompressions- und Dekompressionsschaltungen wesentlich einfacher realisiert werden können.

Wegen der direkten Kabelverbindungen ist außerdem die Bildqualität eines Videosystems unabhängig von den übrigen Vorgängen im Fahrzeug. Neben einem Vorwärtskanal mit einer Bandbreite von 25 Gbit/s oder mehr ist ein Rückkanal mit einer geringeren Übertragungsrate vorhanden. Letzterer eignet sich unter anderem zum Transport eines I2C-Busses mit 400 kbit/s oder für GPIO-Leitungen (General Purpose Input Output) mit bis zu 1 Mbit/s. Der Rückkanal kann dazu genutzt werden, eine Kamera zu konfigurieren, ein Zoomobjektiv einzustellen oder Touchscreen-Informationen an einen Controller zu übertragen, ohne die Videoübertragung auf dem Vorwärtskanal zu unterbrechen.

Für autonome Fahrzeuge kommt als wichtiger Faktor die Latenz der Verbindung hinzu. Diese erhöht sich durch den Verarbeitungsaufwand, der durch die Kompression und Dekompression der Bildsignale entsteht. Bei Unterhaltungsangeboten für die Passagiere auf den Rücksitzen spielt eine etwaige Verzögerung zwischen dem Lesen der Videodaten von einer DVD und der Anzeige auf dem Bildschirm keine Rolle.

Handelt es sich aber um Bilddaten aus einer Kamera, die Fußgänger im Fahrweg des Fahrzeugs erfasst, kann eine etwaige Latenz gravierende Konsequenzen haben. Insgesamt eignet sich FPD-Link ideal für Verbindungen, bei denen große Bandbreite und geringe Latenz die wichtigsten Faktoren sind. Die Unterstützung eines Rückkanals und die Möglichkeit, auch die Stromversorgung über ein einziges Twisted-Pair- oder Koaxialkabel zu führen, macht überdies die Verkabelung einfacher und kann dazu beitragen, die Komplexität des gesamten Systemdesigns zu reduzieren.

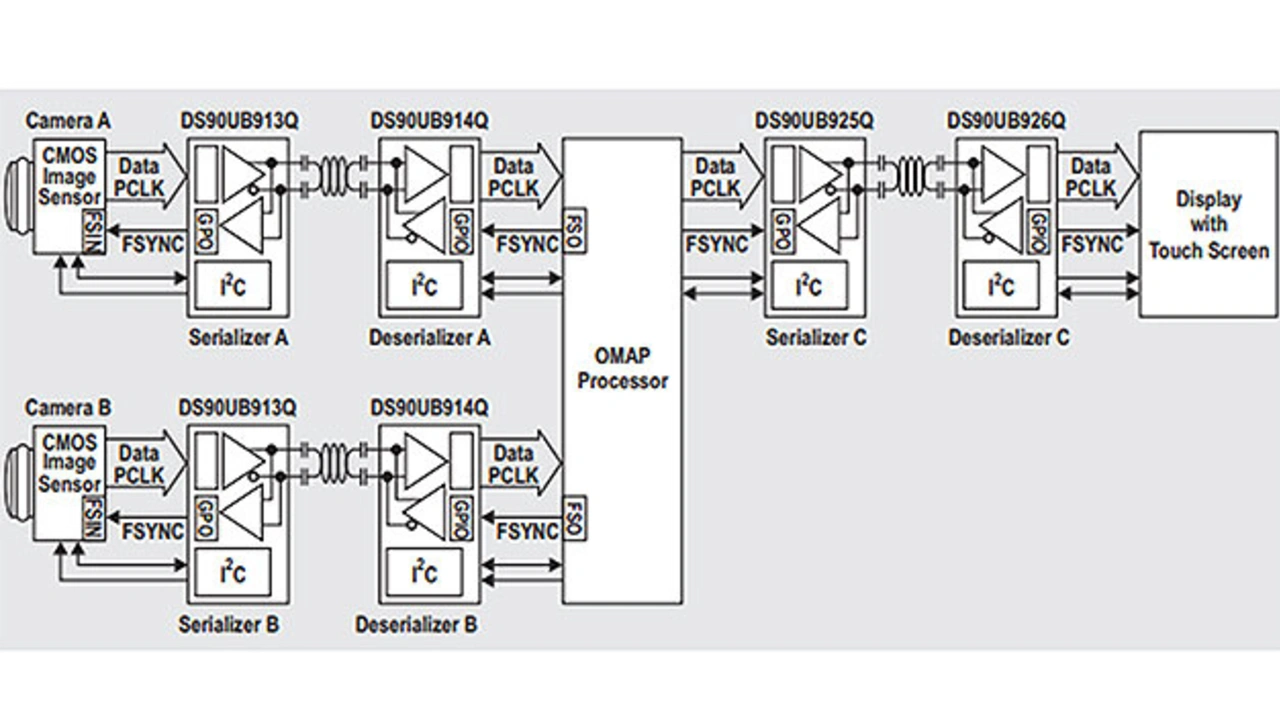

Eine Beispielanwendung ist ein OMAP-Videoprozessor (Open Multimedia Applications Platform), der über ein Twisted-Pair-Kabel mit zwei verschiedenen Kameras und einem Display verbunden ist (Bild). Über dieses Kabel können nicht nur die Videodaten der Kamera sowie Touchscreen- und Konfigurationsdaten übertragen werden, sondern es kann auch für die Stromversorgung des Displays bzw. der Kamera genutzt werden. Da jedes Peripheriegerät über ein eigenes Kabel angeschlossen ist, entfällt das Risiko von Störbeeinflussungen zwischen den Signalen beider Kameras.

Hierdurch verbessert sich die Datenintegrität für die Verarbeitung und Analyse, wodurch die Funktionen des Fahrassistenzsystems an Zuverlässigkeit und Genauigkeit gewinnen. Besonders vorteilhaft ist die Fähigkeit zur Übertragung von Daten aus mehreren Kameras in Surround-View-Anwendungen, wie sie beispielsweise zum automatischen Einparken genutzt werden. Dabei kann ein 360°-Blick auf das Umfeld des Fahrzeugs der Person am Steuer entscheidende Informationen für ein sichereres Fahren zur Verfügung stellen.

CAN-Bus

Die CAN-Kommunikationstechnik wurde seit ihrer Einführung durch Bosch in den 1980er-Jahren entscheidend weiterentwickelt. Mit diesem Multidrop-Netzwerkprotokoll ist es einerseits möglich, den Verkabelungsaufwand im Fahrzeug signifikant zu verringern, während sich andererseits ein auf Arbitrierung basierendes Kommunikationssystem realisieren lässt, das stets dem Knoten mit der höchsten Priorität den Zugriff auf den Bus gewährt. Das CAN-Protokoll und die zugehörige physische Übertragungsschicht wurden Anfang der 1990er-Jahre ursprünglich für Datenraten bis zu 1 Mbit/s standardisiert.

Inzwischen unterstützt die CAN-Kommunikation Übertragungsraten bis zu 10 Mbit/s. Sie schließt damit die Lücke zwischen dem klassischen CAN-Bus der 1990er-Jahre und langsamen Automotive-Ethernet-Implementierungen wie etwa 10Base-T. CAN ist ein serieller Multi-Commander-Bus. Es gibt also nicht nur einen einzigen Commander-Knoten, der darüber entscheidet, wann die einzelnen Knoten Schreib- oder Lesezugriffe auf den Bus ausführen dürfen.

Jeder Nachrichten-Frame enthält einen Identifier, der die Priorität der jeweiligen CAN-Nachricht festlegt. Versuchen mehrere Knoten, gleichzeitig auf dem CAN-Bus zu senden, erhält der Knoten mit der höchsten Priorität, das heißt mit der niedrigsten Arbitrierungs-ID, die Kontrolle über den Bus. Der CAN-Bus zeichnet sich unter rauen Umgebungsbedingungen durch große Zuverlässigkeit aus und ermöglicht den ECUs (Electronic Control Unit) die Kommunikation über ein einziges Leiterpaar.

| Protokoll | Bitrate | Norm | Beschreibung |

|---|---|---|---|

| CAN XL | 10 MBit/s und mehr | CIA 610-1 | Durch das auf 2 kB vergrößerte Datenfeld ist eine noch höhere Bitrate möglich, um die Lücke zwischen CAN und Low-Speed-Ethernet zu schließen. |

| CAN FD SIC | <8 MBit/s | CIA 601-4 | Die »Signal Improvement Capability« reduziert die Oszillationen an den Dominant-Rezessiv-Flanken, um komplexere Topologien zu ermöglichen. |

| CAN FD Light | ≤5 Mbit/s | CIA 604-1 | Zweidraht-Commander/Responder-Architektur mit der Robustheit des Physical Layers von CAN FD |

| CAN FD | <5 MBit/s | ISO 11898 | Durch die flexible Datenrate wird das Datenfeld auf maximal 64 Byte vergrößert, um höhere Bitraten zu ermöglichen. |

| CAN | ≤1MBit/s | ISO 11898 | Serieller Multi-Commander-Zweidrathtbus mit einer maximalen Datenfeldgröße von 8 Byte. |

| Local Network | 1 bis 20 kBit/s | ISO 17987 | Einadrige Commander/Responder-Architektur. |

Tabelle 1. Die Entwicklung der CAN-Technik

Als der CAN-Bus ursprünglich entwickelt wurde, war die Zahl der elektronischen Steuergeräte im Auto noch relativ gering. Inzwischen aber können im Pkw Hunderte von ECUs verbaut sein, deren Aufgaben von essenziellen Funktionen wie der Servolenkung bis zu Komfort-Features wie zum Beispiel Massagefunktionen im Sitz oder Lenkradheizung reichen. Bedingt durch die vielen ECUs und die Forderung nach anspruchsvolleren Sicherheits-Features, kam es auch bei der CAN-Kommunikation zu Weiterentwicklungen.

Tabelle 1 enthält weitere Informationen über CAN-Kommunikationsnetzwerke – darunter auch neue Standards wie etwa CAN FD Light, CAN Signal Improvement Capability (SIC) und CAN Extra Long (XL).

Die PCIe-Technik

PCIe ist ein Kommunikationsstandard für bidirektionale, serielle Highspeed-Busse, von denen große Bandbreite und besonders geringe Latenz gefordert werden. Die hauptsächlich in industriellen Anwendungen gebräuchliche PCIe-Technik findet inzwischen vermehrt Eingang in den Automotive-Sektor, wo die Hersteller anders an die Gestaltung des Daten-Backbones herangehen, um breitbandige, latenzarme Systeme zu unterstützen. Letztere müssen den exponentiell steigenden Umfang an Sensordaten und Benutzereingaben bewältigen, den es in Echtzeit zu verarbeiten gilt.

Um diesen Herausforderungen gerecht zu werden, unterstützt ein zentralisierter Rechnerknoten mehrere Arten von Domains (ADAS, Infotainment, Antriebsstrang). Eine solche zentrale Rechnereinheit würde normalerweise aus mehreren Modulen zusammengesetzt werden, die jeweils verschiedene Funktionen des Fahrzeugs unterstützen.

Dies würde den Fahrzeugherstellern die Flexibilität zum Up- und Downscaling und zur individuellen Anpassung der Fahrzeugausstattung einräumen, ohne dass der komplette Domain Controller neu entwickelt werden müsste. Da PCIe einen Root Complex oder eine CPU für mehrere Endpunkte oder Empfänger unterstützt, kann ein zentralisiertes, modulares Design auf PCIe-Basis dazu beitragen, die Anzahl der insgesamt im Fahrzeug benötigten ECUs und Kabel deutlich zu reduzieren.

Als die Automobilindustrie begann, Co-Processing und Redundanz über den Daten-Backbone hinweg zu fordern, wuchs die Attraktivität der PCIe-Technik, da viele CPUs mit einer eingebauten, nativen PCIe-Schnittstelle ausgestattet sind und somit keine zusätzlichen Schnittstellenkonvertierungen über die Backplane erfordern. Für PCIe existiert zudem ein enorm umfangreiches Ökosystem an offenen Softwareressourcen, und seine Bandbreite hat sich von Generation zu Generation fortlaufend verdoppelt. Abgesehen davon ist die Bandbreite in hohem Maße skalierbar. So kann das PCIe-Protokoll dem Bandbreitenbedarf gerecht werden, der sich aus dem exponentiell wachsenden Aufkommen an Datenverarbeitung im Automotive-Bereich ergibt.

| Linearer PCIe-Redriver | PCIe-Retimer |

|---|---|

| Geringe Leistungsaufnahme (kein Kühlkörper erforderlich) | Hohe Leistungsaufnahme (Kühlkörper in den meisten Fällen notwendig) |

| Extrem geringe Latenz (100 ps) | Mittlere Latenz (≤64 ns gemäß PCIe 4.0) |

| Nicht am Link Training beteiligt, aber transparent für Aushandlungen zwischen Root Complex (CPU) und Endpunkt (EP) (protokollunabhängig) | Vollständig am Link Training mit Root Complex (CPU) und Endprodukt beteiligt |

| Kein 100-MHz-Referenztakt erforderlich | 100-MHz-Referenztakt erforderlich |

| Abhilfe gegen Einfügedämpfung | Abhilfe gegen Einfügedämpfung, Jitter, Übersprechen, Reflexionen und Lane-to-Lane Skew |

| CTLE (Continuous Time Linear Equalizer) als übliche Entzerrerschaltung | CTLE, DFE (Decision Feedback Equalizer) und senderseitiger FIR-Filter sind die üblichen Entzerrerscheinungen |

| Gesamt-Lösungskosten werden mit 1 angesetzt | Gesamt-Lösungskosten sind um den Faktor 1,3 bis 1,5 höher |

Tabelle 2. Vergleich zwischen PCIe-Redriver und PCIe-Retimer.

Zu einer erheblichen Herausforderung beim Design schneller Datenpfade kann die Verschlechterung der Signalqualität werden. Unter Umständen wird deshalb ein Signalaufbereiter wie etwa ein Redriver oder Retimer zur Regenerierung und zum Kompensieren der Einfügedämpfung und des Rauschens benötigt. Als Ursachen hierfür sind das Leiterplattenmaterial, Vias, Steckverbinder und Kabel anzuführen. Sowohl Redriver als auch Retimer haben sich im PCIe-Ökosystem in hohem Maße bewährt und können die allgemeine Signalintegrität beim Transport von Daten mithilfe des PCIe-Protokolls verbessern. In Tabelle 2 sind die Unterschiede zwischen Redrivern und Retimern zusammengefasst.

Welche Kommunikationstechnik für welche Anwendung?

Bezüglich der Frage, welches Protokoll für die Kommunikation im Automotive-Bereich am besten geeignet ist, lässt sich feststellen: Jede der hier beschriebenen Alternativen ist geeignet, aber jede hat ihren besonderen Einsatzbereich. Bei größerem Bandbreitenbedarf, wie etwa zur Übertragung von Radar- und Lidardaten, ist Ethernet die richtige Wahl. Wird besonders große Bandbreite und besonders geringe Latenz benötigt, wie etwa bei Surround-View-Kameras für autonome Fahrzeuge, kann FPD-Link die Anforderungen erfüllen.

Der CAN-Bus stellt weiterhin die passende Lösung für ADAS-Anwendungen mit geringen Übertragungsraten dar, bei denen es auf die Kosten ankommt. Beispiele hierfür sind die Datenpriorisierung oder die Airbag-Auslösung. PCIe schließlich kann den Anforderungen bei der Übertragung der immer umfangreicher werdenden Sensordaten und Benutzereingaben gerecht werden, die in Echtzeit verarbeitet werden müssen. Gemeinsam ergeben diese vier wichtigen Automotive-Kommunikationsprotokolle ein integriertes, vernetztes Fahrzeug, das Echtzeitunterstützung für die Fahrsicherheit bietet und den kontinuierlich wachsenden Anforderungen von ADAS-Architekturen gerecht wird.

Literatur

[1] What is FPD-Link?: https://www.ti.com/video/6094247787001?HQS=null-nulladas-adascomm-vanity-tr-fpd-link-wwe

[2] Introduction to the Controller Area Network (CAN): https://www.ti.com/lit/an/sloa101b/sloa101b.pdf?ts=1698072099217

[3] Solving PCIe signal integrity challenges: https://www.ti.com/video/6051762921001?HQS=null-null-adasadascomm-vanity-tr-pcie-wwe

Die Autoren

Chanakya Mehta ist Systems and Applications Manager

FPD-Link SerDes bei Texas Instruments.

Shannon Lippincott ist Product Marketing Engineer Transceivers

bei Texas Instruments.

Connie Lu ist Product Marketing Engineer PCIe

Products bei Texas Instruments.