Transfer Learning

KI nutzen– auch ohne umfangreiche Trainingsdaten

Maschinelles Lernen (ML, insbesondere Deep Learning) ist ein wichtiges Werkzeug in der Spracherkennung, Bildanalyse, Prozesssteuerung etc. Auch Unternehmen ohne umfangreiche Trainingsdaten können ML nutzen, denn NVIDIA stellt Modelle und Tools für Transfer Learning zur Verfügung.

Was ist Transfer Learning? Die grundlegende Idee des Transfer Learnings besteht darin, bereits gelerntes Wissen aus Aufgaben, für die viele Trainingsdaten zur Verfügung stehen, für Aufgaben zu nutzen, für die nur wenige Trainingsdaten zur Verfügung stehen. Von entscheidender Bedeutung ist daher die optimale Nutzung vorhandener Datensätze.

Beim herkömmlichen maschinellen Lernen besteht das Hauptziel darin, auf Grundlage von Mustern, die mithilfe von Trainingsdaten gelernt wurden, auf unbekannte Daten zu generalisieren. Beim Transfer Learning versucht man diesen Generalisierungsprozess in Gang zu setzen, indem man von Mustern ausgeht, die für eine andere Aufgabe gelernt wurden. Man beginnt also nicht bei Null, sondern mit Mustern, die zur Lösung einer anderen Aufgabe gelernt wurden.

Dies funktioniert, da viele der ersten Schichten in einem neuronalen Netz für ähnliche Aufgaben gleich sind. Im Bereich Computer Vision werden beispielsweise viele der ersten Schichten in einem Convolutional Neural Network (CNN) in erster Linie zur Erkennung von Umrissen, Kurven und anderen Merkmalen in einem Bild verwendet. Die gelernten Merkmale aus diesen Schichten können auf ähnliche Aufgaben angewendet werden, die die gleiche Identifizierung in anderen Bereichen durchführen. Daher lässt sich ein Modell mittels Transfer Learning mit weniger Daten genauso gut für eine bestimmte Aufgabe trainieren, als wenn dasselbe Modell von Grund auf neu trainiert würde.

Wann und wie wird Transfer Learning eingesetzt?

Ein Beispiel aus der Bilderkennung wäre die Erkennung einer bestimmten Tierart. Gibt es keine öffentlich verfügbaren Algorithmen, die diese Aufgabe angemessen erfüllen, kann man Transfer Learning einsetzen. Hierbei beginnt man mit einem bestehenden Convolutional Neural Network (CNN), in diesem Fall z.B. eines, das für die Erkennung anderer Tiere verwendet wird, und optimiert es für das Training mit der gewünschten Tierart.

Da tiefe neuronale Netze in immer vielfältigeren Bereichen eingesetzt werden, hat sich Transfer Learning zu einer sehr beliebten Technik bei der Entwicklung von tiefen Lernmodellen entwickelt. Beim Transfer-Lernen wird das neuronale Netz in zwei Stufen trainiert:

1) Pretraining, bei dem das Netz typischerweise auf einem großen Benchmark-Datensatz trainiert wird, der eine große Vielfalt an Bezeichnungen/Kategorien repräsentiert

2) Feinabstimmung, bei der das vortrainierte Netz auf der spezifischen Zielaufgabe weiter trainiert wird. Und in diesem Fall kann der verfügbare Datensatz kleiner sein als der für das Pretraining. Das Pretraining hilft dem Netz, allgemeine Merkmale zu erlernen, die für die Zielaufgabe wiederverwendet werden können.

Transfer Learning gilt als Schlüssel, um Deep-Learning-Techniken in all den Anwendungen nutzbar zu machen, die über wenig Trainingsdaten verfügen. Denn bislang ist Deep Learning in der Forschung zwar so gut wie allgegenwärtig, aber in vielen realen Szenarien gibt es typischerweise nicht ausreichendes Datenmaterial, um ein Modell zu trainieren. Denn um die Genauigkeit von Deep-Learning-Techniken nutzen zu können, sind sehr große Datenmengen notwendig, mit denen Parameter in einem neuronalen Netz abgestimmt werden können.

Jobangebote+ passend zum Thema

Leistungsfähige, vortrainierte Modelle aus der NVIDIA GPU Cloud (NGC)

NVIDIA bietet in der NVIDIA GPU Cloud (NGC) eine Vielzahl von vortrainierten (production ready) Modellen an, die kostenfrei für Transfer Learning verwendet werden können. Diese Modell-Bibliothek enthält beispielsweise Modelle für die Personen- oder Fahrzeugerkennung (inkl. Nummernschilderkennung) sowie für Gesichtserkennung und Lagebestimmung (Pose Estimation). Die Modelle sind für einen hohen Durchsatz optimiert und wurden auf eine Genauigkeit von über 80 Prozent trainiert.

Für den Bereich »Computer Vision« gibt es grundsätzlich zwei Arten von vortrainierten Modellen, mit denen Benutzer beginnen können.

Zum einen stehen speziell angefertigte vortrainierte Modelle zur Verfügung. Dabei handelt es sich um hochpräzise Modelle, die mit einer sehr großen Menge an Trainingsdaten für eine bestimmte Aufgabe trainiert wurden. Diese domänenspezifischen Modelle können entweder direkt für die Inferenz verwendet werden oder mit dem TAO Toolkit von NVIDIA für das Transfer Learning mit den eigenen Datensätzen des Benutzers. Das domänenspezifische Modell »LPDNet« erkennt ein oder mehrere Nummernschilder in einem Fahrzeugbild und liefert einen Rahmen um jedes Objekt sowie ein LPD-Label für jedes Objekt zurück. Das domänenspezifische Modell »PeopleNet« kann in einem Bild ein oder mehrere physische Objekte aus drei Kategorien (Personen, Taschen und Gesichter) innerhalb eines Bildes erkennen und um jedes Objekt einen Rahmen sowie eine Kategoriebezeichnung für jedes Objekt zurückgeben.

Zum anderen stehen mit ResNet-50 und SSD auch »General Purpose«-Modelle zur Verfügung. Die vortrainierten Gewichte für diese Modelle dienen als Ausgangspunkt für die Erstellung komplexerer Modelle. Für Computer-Vision-Anwendungsfälle werden diese vortrainierten Gewichte auf offenen Bilddatensätzen trainiert und bilden einen deutlich besseren Ausgangspunkt für das Training als eine zufällige Initialisierung der Gewichte. Bei diesen Modellen kann der Benutzer aus über 100 Permutationen der Modellarchitektur und des Backbones wählen.

Einfach kundenspezifische KI-Modelle erstellen

Das NVIDIA TAO Toolkit wird zusammen mit vortrainierten NVIDIA-Modellen verwendet, um benutzerdefinierte CV- (Computer Vision) oder Sprach-KI-Modelle auf Basis von kundenspezifischen Nutzerdaten zu erstellen. Das TAO Toolkit abstrahiert die Komplexität des KI-Frameworks und ermöglichet es so Anwendern, KI-Modelle in Produktionsqualität zu erstellen, ohne dass sie dafür Kenntnisse in KI oder Deep Learning haben müssen. Mit einem grundlegenden Verständnis von Deep Learning und minimalem bis gar keinem Programmieraufwand können TAO Toolkit-Benutzer beispielsweise die Feinabstimmung von Modellen für CV-Anwendungsfälle wie Objekterkennung durchführen, aber auch neue Klassen zu einem bestehenden, bereits trainierten Modell hinzufügen. Darüber hinaus lassen sich Modelle auch neu trainieren, um diese an verschiedene Anwendungsfälle anzupassen. Und es ist möglich, die Modelle zu »bereinigen«, um dadurch die Gesamtgröße des Modells zu reduzieren.

Zusammenfassung

Transfer Learning mit dem TAO Toolkit von NVIDIA ermöglicht die Erstellung eigener KI-Netze und dabei im Vergleich zu einer »Erstellung from Scratch« bis zu 90 Prozent an Zeit und Kosten einzusparen.

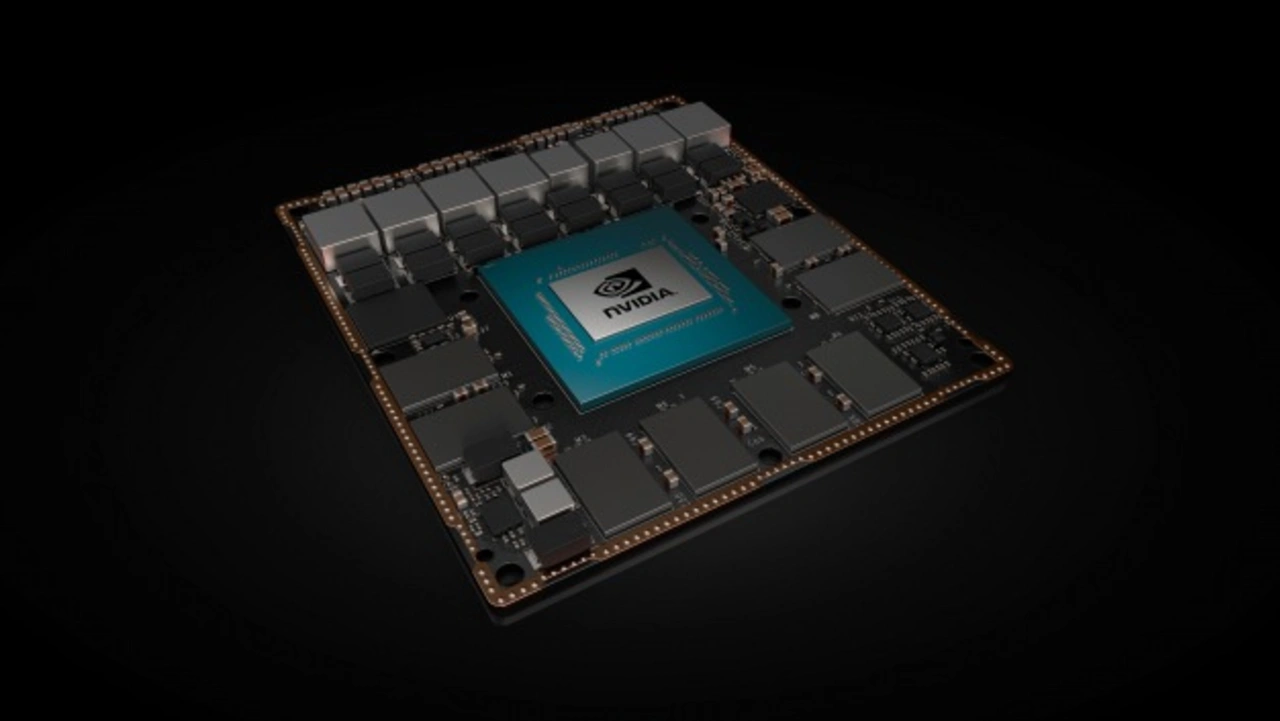

Darüber hinaus steht mit NVIDIA Jetson eine leistungsfähige und skalierbare Plattform zur Verfügung um Transfer Learning »out of the box« in energiesparenden sowie leistungsfähigen Edge-Geräten zu integrieren.

Alle Module und Evaluation Kits der NVIDIA Jetson Familie sowie ein umfangreiches Portfolio an Carrier Boards sowie Kameralösungen sind über Arrow erhältlich. Über das Field Engineering, das leistungsfähige Partnernetzwerk sowie über eInfochips (an Arrow Company) bietet Arrow darüber hinaus umfangreiche Design-In Services, um die Time-to-Market sowie das Entwicklungsrisiko soweit möglich zu reduzieren.

Autor:

Danny Lenz ist Technology Field Application Engineer bei Arrow Electronics