Klassifizierung oder Detektierung?

Wie sich die Anforderungen von Lidar-Systemen unterscheiden

Fortsetzung des Artikels von Teil 1

Die Evaluierung

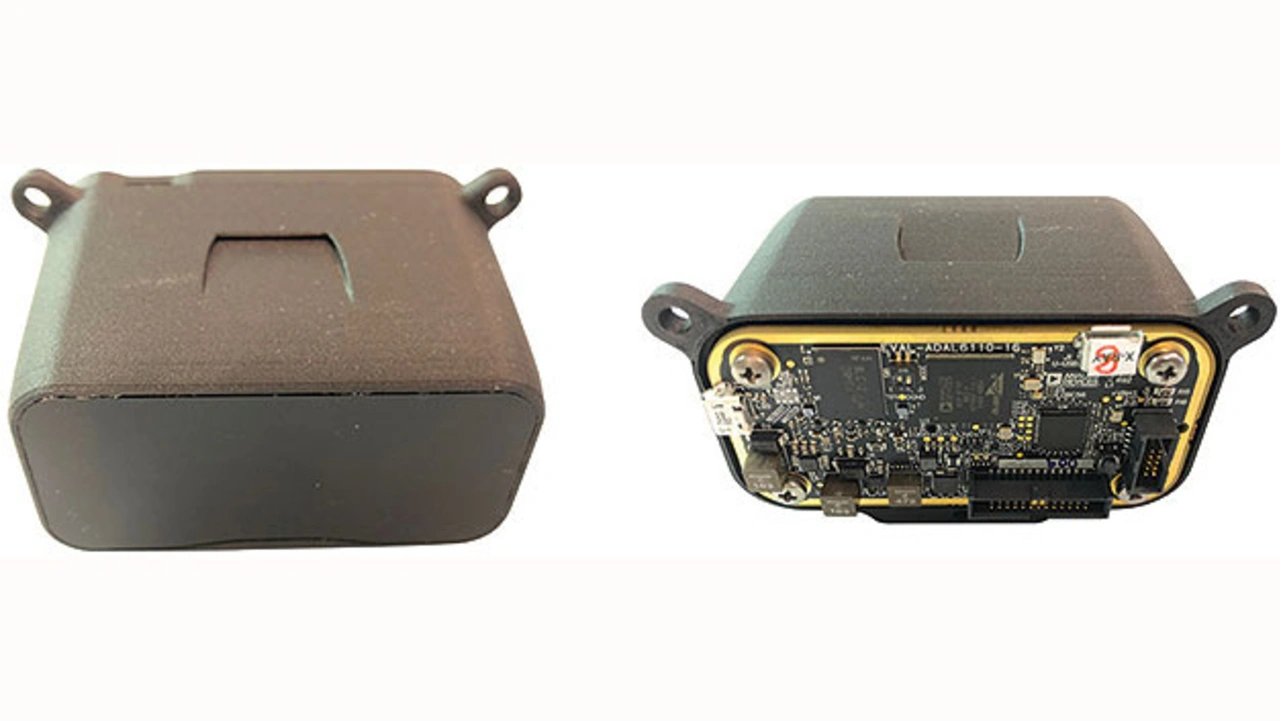

Das als Hilfestellung zum Design von Lidar-Systemen konzipierte EVAL-ADAL6110-16 (Bild 4) ist ein hochgradig konfigurierbares Evaluierungssystem. Es enthält einen vereinfachten, aber dennoch konfigurierbaren 2D-Flash-Lidar-Tiefensensor für Anwendungen, die nach Objekterkennung und -verfolgung in Echtzeit (65 Hz) verlangen. Beispiele hierfür sind die Kollisionsvermeidung, die Höhenüberwachung sowie das sanfte Landen.

Die in dem Referenzdesign verwendete Optik ermöglicht ein Sichtfeld (Field of View, FOV) von 37° in Azimut- und 5,7° in Elevationsrichtung. Mit einem linearen Array aus 16 Pixeln in Azimutrichtung entspricht die Pixelgröße in 20 m Entfernung einem durchschnittlichen Erwachsenen (0,8 m in Azimut- und 2 m in Elevationsrichtung). Wie bereits erwähnt, setzen verschiedene Anwendungen möglicherweise unterschiedliche optische Konfigurationen voraus. Sollte die vorhandene Optik nicht den Anforderungen der Applikation genügen, kann die Leiterplatte einfach aus dem Gehäuse ausgebaut und in eine andere optische Konfiguration integriert werden.

Das Evaluierungssystem basiert auf dem ADAL6110-16 von ADI, einem stromsparenden, 16-kanaligen, integrierten Lidar-Signalprozessor (LSP). Der Baustein enthält eine Timing-Steuerung zum Ausleuchten des interessierenden Bereichs, das Timing zum Abtasten der empfangenen Welle und die Fähigkeit zur Digitalisierung der erfassten Wellenform.

Die beim ADAL6110-16 erfolgte Integration empfindlicher analoger Knoten reduziert das Grundrauschen und befähigt das System damit zur Erfassung sehr schwacher Rücksignale. Im Gegensatz dazu könnte bei der Implementierung der gleichen Signalkette aus diskreten Bauelementen mit ähnlichen Kenndaten das RMS-Rauschen das Design dominieren. Nicht zuletzt ermöglicht die integrierte Signalkette das Design von Lidar-Systemen mit weniger Platzbedarf, Gewicht und Strombedarf.

Die Systemsoftware gestattet ein schnelles Hochfahren, um Messungen vorzunehmen und mit einem Entfernungsmesssystem zu arbeiten. Sie ist vollkommen eigenständig und benötigt eine einzige, per USB zur Verfügung gestellte Versorgungsspannung von 5 V. Mithilfe der zur Verfügung stehenden ROS-Treiber (Robot OS) lässt es sich einfach in ein autonomes System integrieren. Der Anwender benötigt lediglich einen Steckverbinder für den Header, um einen Roboter oder ein Fahrzeug anzuschließen. Die Kommunikation kann dabei über eines von vier Protokollen (SPI, USB, CAN oder RS-232) erfolgen. Auch an andere Empfänger- oder Emitter-Technologien lässt sich das Referenzdesign anpassen.

Die Konfiguration

Wie erwähnt kann die Empfängertechnologie des Referenzdesigns EVAL-ADAL6110-16 modifiziert werden, um verschiedene Konfigurationen zu realisieren. Standardmäßig ist das EVAL-ADAL6110-16 mit einem aus 16 Elementen bestehenden Photodioden-Array des Typs Hamamatsu S8558 bestückt.

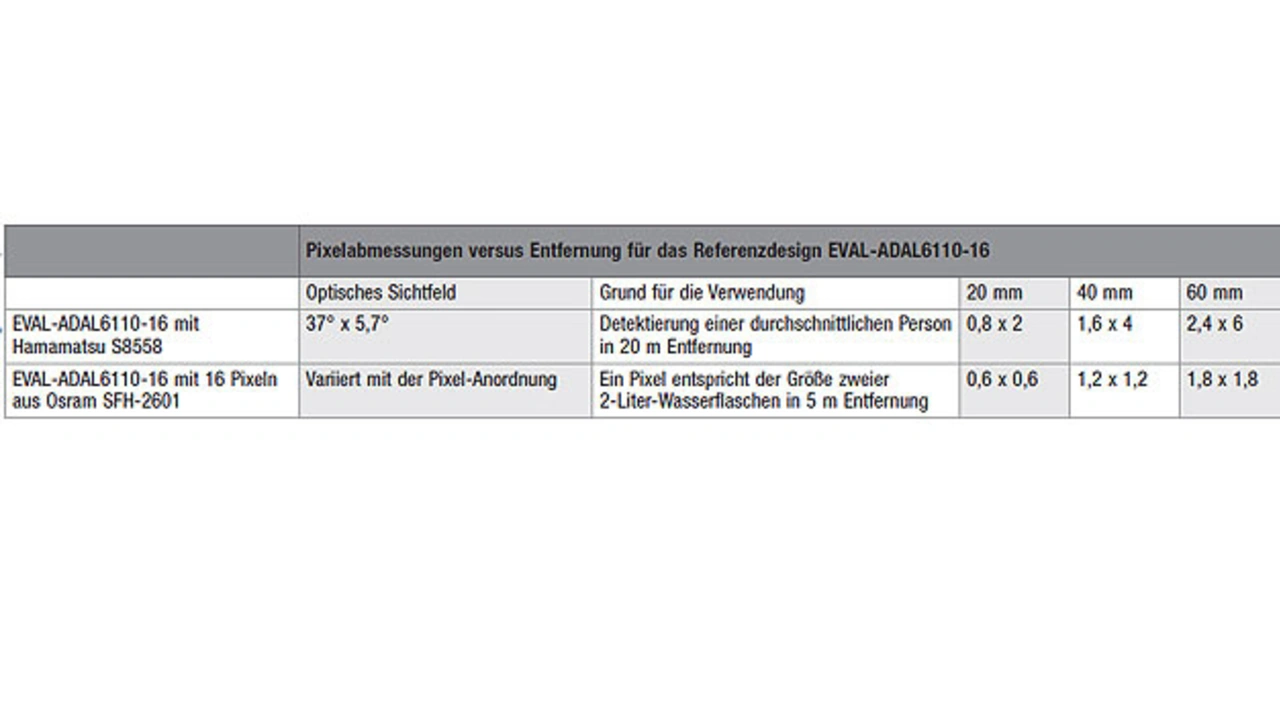

Die in Tabelle 1 aufgeführte Pixelgröße bei verschiedenen Distanzen basiert auf den effektiven Pixelabmessungen von 0,8 mm x 2 mm sowie der Objektivbrennweite von 20 mm. Zum Vergleich wurde das Board mit einzelnen Photodioden beispielsweise vom Typ Osram SFH-2701 ausgerüstet, deren aktive Fläche 0,6 mm × 0,6 mm beträgt. Hierbei würden sich bei gleichen Entfernungen völlig andere Pixelgrößen ergeben, da sich das Sichtfeld mit den Abmessungen der Pixel ändert.

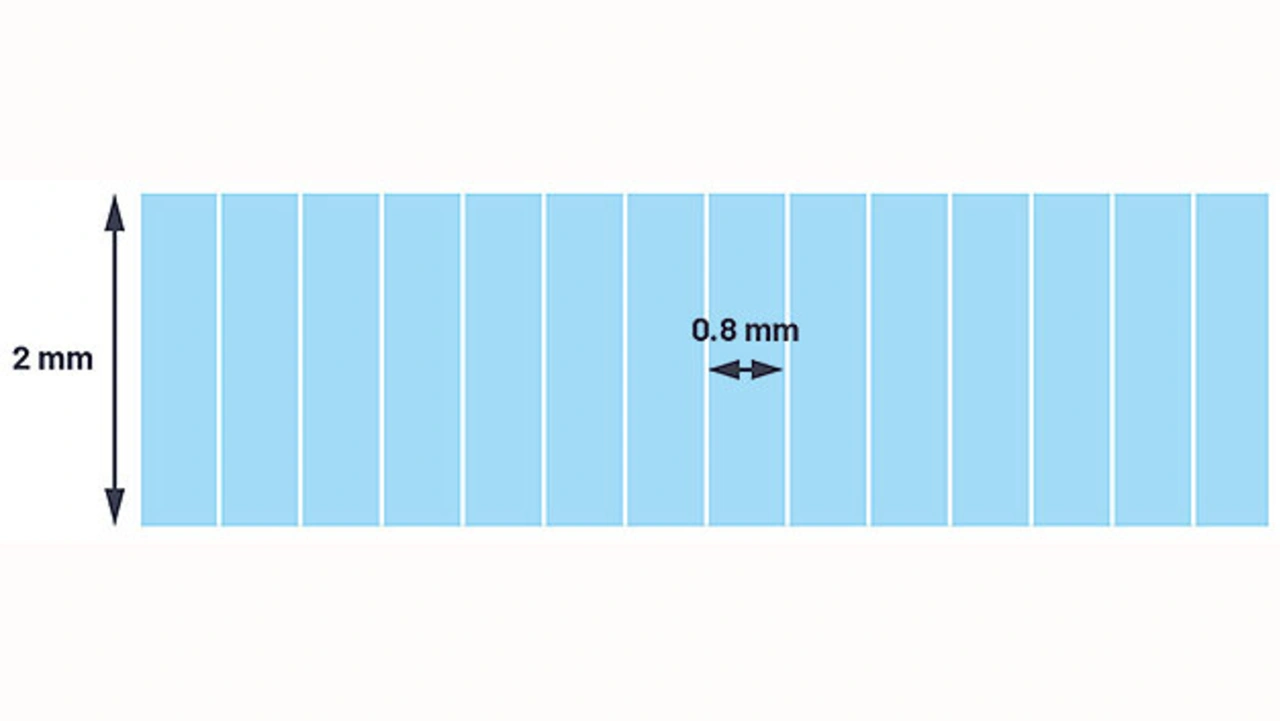

Als Beispiel soll im Weiteren das S8558 mit seinen 16 in einer Reihe angeordneten Pixeln betrachtet werden (Bild 5).

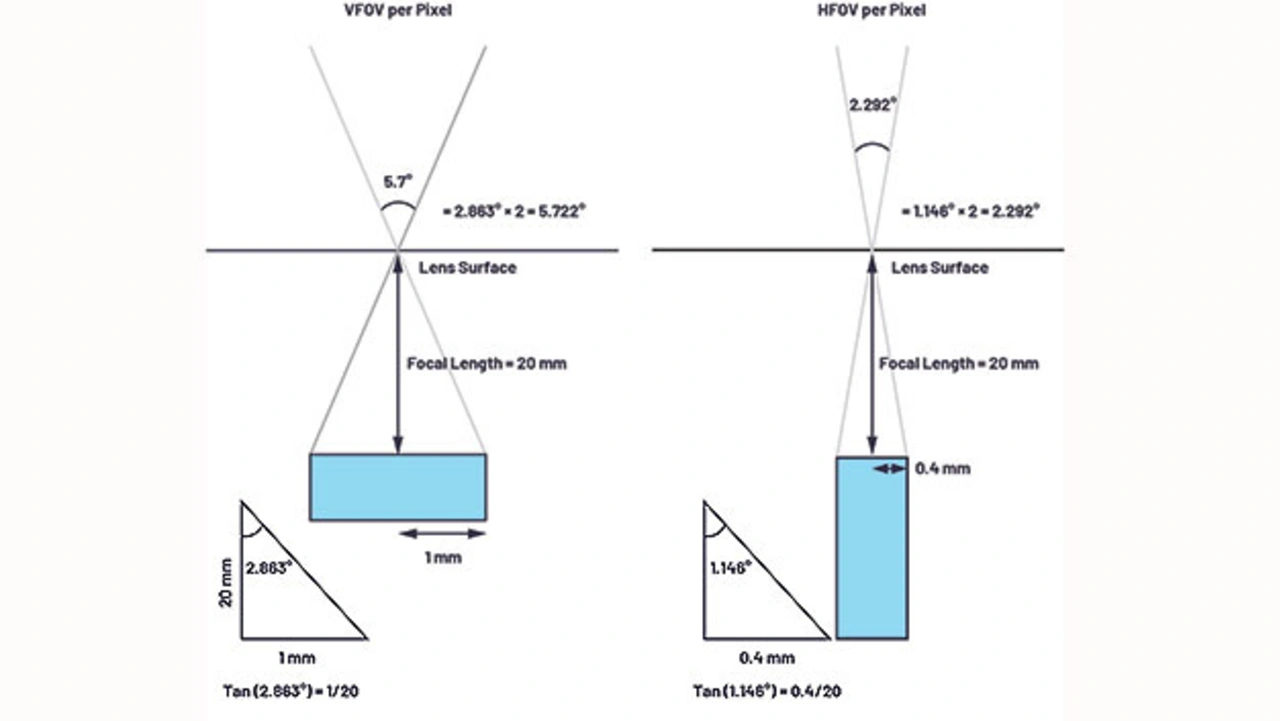

Nach Auswahl eines Objektivs mit 20 mm Brennweite lässt sich das horizontale und vertikale Sichtfeld mithilfe einfacher trigonometrischer Berechnungen ermitteln (Bild 6). Natürlich können bei der Objektivauswahl komplexere Betrachtungen erforderlich sein – wie etwa die Aberrationskorrektur und die Bildfeldwölbung. Bei gering auflösenden Systemen aber reichen einfache Berechnungen oftmals aus.

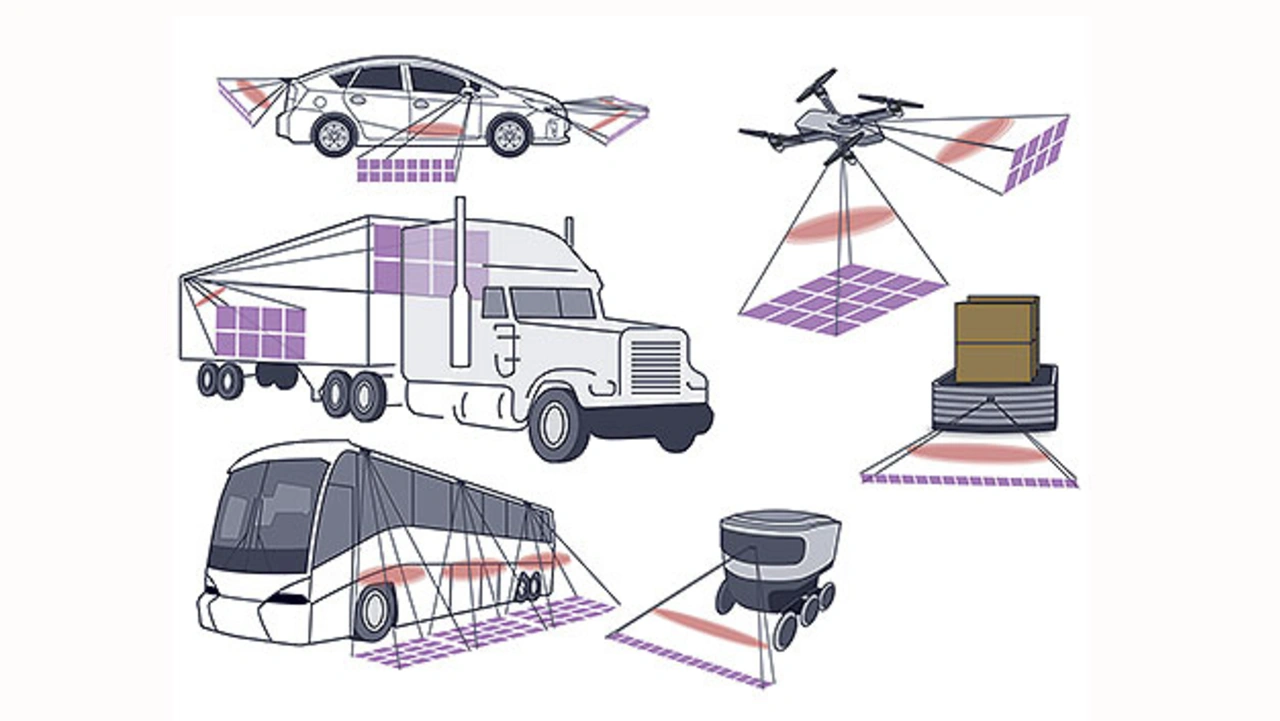

Das gewählte Sichtfeld von 1 x 16 Pixeln eignet sich für Anwendungen wie die Objektdetektierung und Kollisionsvermeidung von autonomen Fahrzeugen und selbstfahrenden Transportfahrzeugen, oder für SLAM-Funktionen (Simultaneous Localization And Mapping) von Robotern bei beengten Platzverhältnissen wie beispielsweise in Lagerhallen.

In einer speziellen Applikation geht es um das Konfigurieren des Arrays als 4x4-Raster, um Objekte im Umfeld eines Systems zu detektieren (Bild 7). Dieses in der Entwicklung befindliche System soll an Bussen und Wohnmobilen zum Einsatz kommen und als „Sicherheitsblase“ fungieren, die den Fahrer warnt, sobald eine unaufmerksame Person dem Fahrzeug zu Nahe kommt. Das System könnte die Richtung erkennen, in die sich die Person bewegt, und den Fahrer zu einer Reaktion, wie Fahrzeug anhalten oder Hupe betätigen, auffordern.

Die Autoren

Sarven Ipek

kam 2006 zu Analog Devices, wo er sich umfangreiche Kenntnisse in den Bereichen Fehleranalyse, Design, Charakterisierung, Produktentwicklung sowie Projekt- und Programm- management aneignete. Derzeit ist Ipek als Marketing Manager in der Lidar Division der Autonomous Transportation and Safety Group bei Analog Devices in Wilmington, Massachusetts, tätig. Er hat einen Bachelor of Science in Elektro- und Computertechnik sowie einen Master of Science in Elektrotechnik mit Schwerpunkt Kommunikationssysteme und Signalverarbeitung, beide von der Northeastern University.

sarven.ipek@analog.com

Ron Kapusta

ist ein Analog Devices Fellow und besitzt einen Bachelor of Science und einen Master of Engineering vom Massachusetts Institute of Technology. Nach seinem Studienabschluss im Jahr 2002 begann er bei Analog Devices mit der Entwicklung von Datenwandlern und Sensor-Schnittstellenschaltungen für digitale Bildgebungssysteme. Im Jahr 2014 verlagerte Kapusta seinen Schwerpunkt auf die Automobiltechnik und arbeitete an Elektronik, Photonik und Signalverarbeitung für Lidar-Sensoren. Kapusta gehörte auch den Programmkomitees diverser IEEE-Konferenzen an.

ron.kapusta@analog.com

- Wie sich die Anforderungen von Lidar-Systemen unterscheiden

- Die Evaluierung