Softwareoptimierung

Nebel – und dennoch klare Sicht

Fortsetzung des Artikels von Teil 1

Das Capsule Neural Network

Zur Zeit als EDAG seine Lösung SmoFod entwickelte, veröffentlichten Hinton et al. ein Paper zu einer neuartigen Netzarchitektur namens »Capsule Neural Network« [4]. Diese Netzarchitektur erschien vielversprechend und sollte dabei helfen, die letzten Hindernisse zu überwinden, vor denen EDAG bei der Bildentnebelung noch stand. Die Netzarchitektur des CapsNet basiert auf einem Convolutional Neural Network (CNN). Das Hauptanwendungsgebiet von CNNs ist die Bildverarbeitung. Durch ihre spezielle Funktionsweise ist die Anzahl der trainierbaren Parameter geringer als bei einem Fully Connected Neural Network, weshalb sie bestens dazu geeignet sind, Bilder zu verarbeiten.

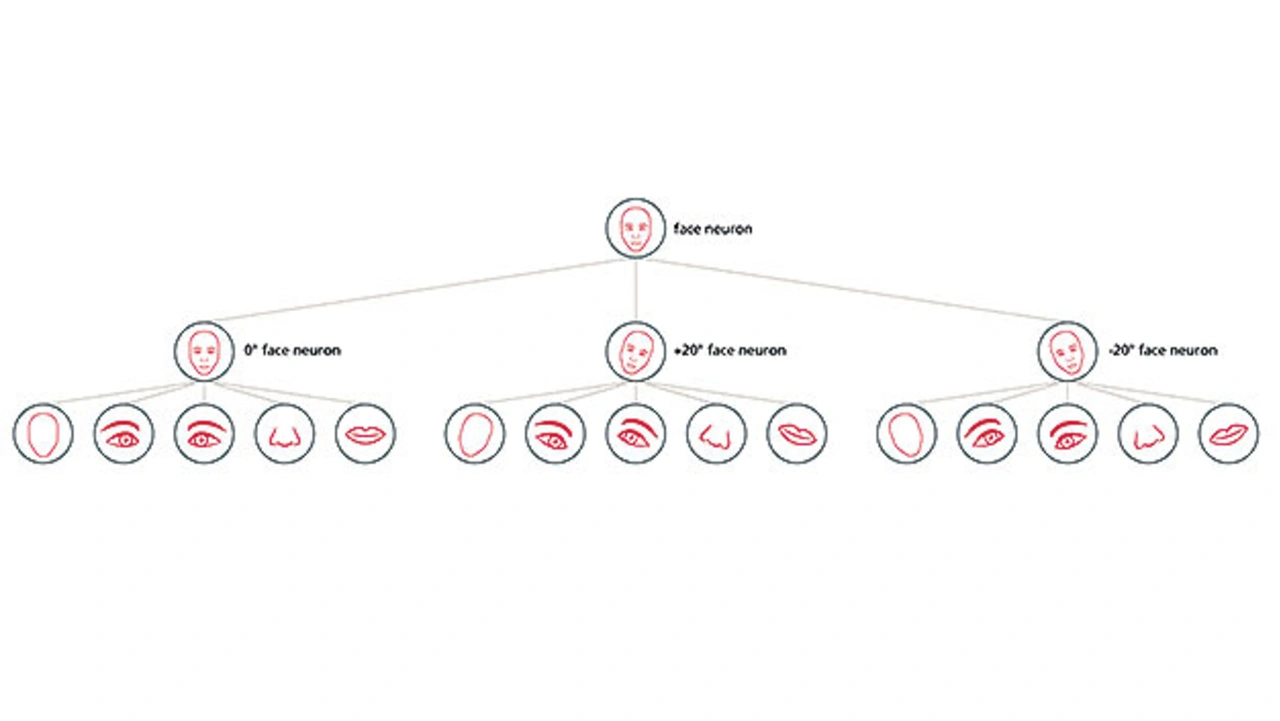

Ein CNN extrahiert Merkmale aus der Eingabe, indem es einen Filter über das Bild laufen lässt. Die Einträge des Filters werden gelernt und die Merkmalsextraktion derart gesteuert, dass sie maximal hilfreich für das bestmögliche Ergebnis ist. Somit werden nicht alle Neuronen einer Schicht für die Berechnung eines Neurons in der nächsten verwendet, sondern nur ein kleiner Teil. Auf diese Art können Merkmale wie Augen, Nase und Mund eines Gesichts extrahiert werden. Wenn das Gesicht geneigt ist, werden dieselben Merkmale in geneigter Stellung extrahiert. Genau an diesem Punkt setzt das Capsule Neural Network an (Bild 2).

![Merkmalsextraktion mit Zusatzinformationen eines CapsNet in vereinfachter Darstellung [5] Merkmalsextraktion mit Zusatzinformationen eines CapsNet in vereinfachter Darstellung [5]](https://cdn.elektroniknet.de/thumbs/media_uploads/images/1627378389-270-wormlqlkb.jpg.1280x0.webp)

Im CapsNet werden zusätzliche Informationen zu den Merkmalen gespeichert. Diese Informationen können beispielsweise die Neigung eines Kopfes oder auch die Strichdicke einer handgeschriebenen Ziffer darstellen. Dadurch lässt sich die Anzahl unterschiedlicher Merkmale reduzieren und die Leistungsfähigkeit steigern (Bild 3). Eine weitere Eigenschaft, die das CapsNet neu in die Welt des Deep Learning mitbringt, ist das sogenannte Routing-by-Agreement. Hierdurch werden Informationen nur an diejenigen Neuronen der nächsten Schicht weitergegeben, die durch diese Merkmale am besten repräsentiert werden. Hinton et al. stellten das CapsNet am Beispiel der Klassifikation von handgeschriebenen Ziffern des MNIST-Datensatzes vor. Die Performance des CapsNets war überraschend. Die Klassifikationsperformance einzelner Ziffern war State of the Art und die Performance für überlappende Ziffern lag sogar darüber.

Die Weiterentwicklung des SmoFod

Aufgrund der neuartigen Funktionsweise des CapsNets sollte durch die Integration der CapsNet-Eigenschaften in SmoFod eine verbesserte Bildrekonstruktion erzielt werden. Da das CapsNet auf eine Bildklassifikationsaufgabe ausgelegt war, wurde zunächst die Netzarchitektur zum Zwecke einer Bildrekonstruktion abgeändert.

Für Rekonstruktionsaufgaben werden häufig Autoencoder verwendet. Diese bestehen aus einem Encoder und einem Decoder. Der Encoder codiert die Eingabedaten. Die codierten Daten werden an einen Decoder übergeben, der sie wieder in ihre Ursprungsform zurückführt. Durch die Komprimierung der Daten werden die Merkmale erhalten, die für die Rekonstruktion wichtig sind, und alle anderen verworfen. Es wurde eine neuartige Architektur auf Basis eines Autoencoders mit den Eigenschaften des CapsNets entwickelt. Somit war der Autoencoder in der Lage, zusätzliche Informationen zu den extrahierten Merkmalen zu speichern und zu entscheiden, welche Neuronen welche Informationen erhalten sollen.

Es ließ sich eine deutliche Verbesserung der Ergebnisse im Vergleich zu dem zuvor implementierten Modell erzielen. Diese Verbesserungen beziehen sich sowohl auf die Farbdarstellung der Ergebnisse, sowie auf die Erkennungsraten des Objektklassifikators YOLO [6].

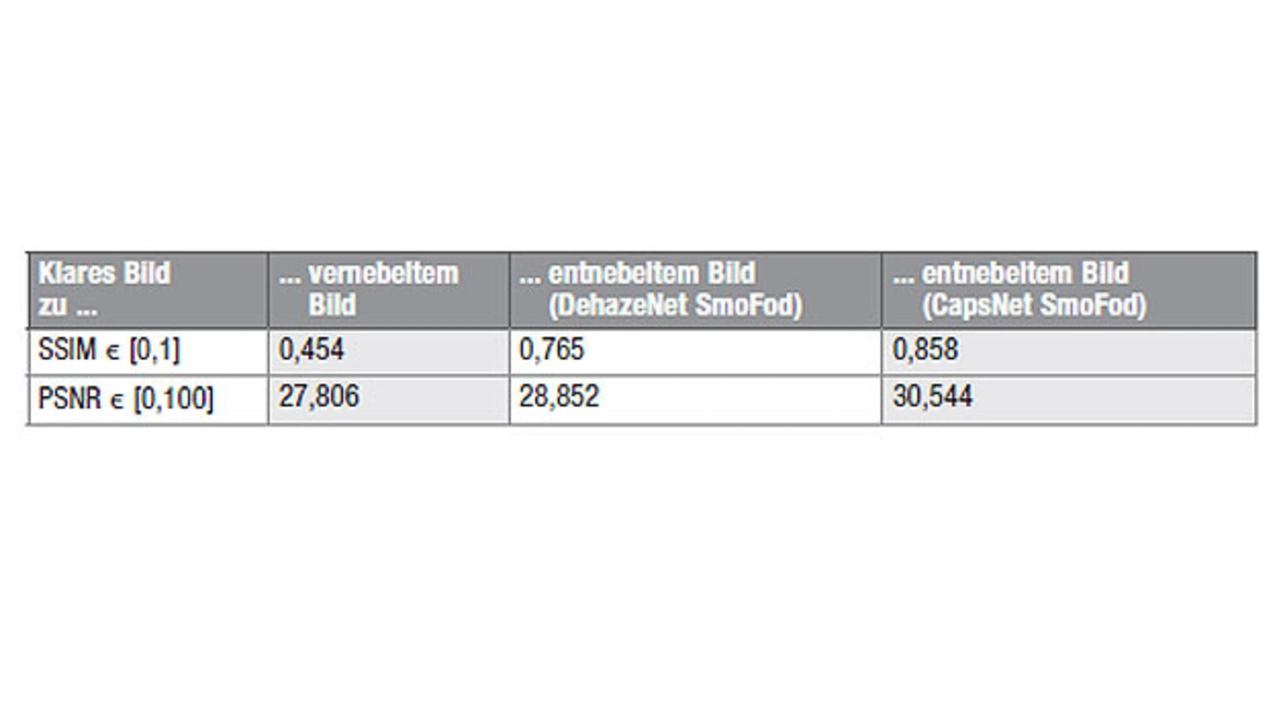

Zur Berechnung der Ähnlichkeiten zwischen zwei Bildern wird oft der Peak-Wert des Signal-Rausch-Verhältnisses (PSNR) oder der Structural Similarity Index (SSIM) herangezogen. Der PSNR ist eine pixelbasierte Metrik, welche auf dem bekannten Mean Squared Error (MSE) beruht.

Der Nachteil von pixelbasierten Metriken ist, dass Abhängigkeiten zwischen den Pixeln nicht berücksichtigt werden und daher nicht das Bild im Ganzen »gesehen« wird. Der SSIM hingegen bezieht diese Abhängigkeiten in Form von Kontrast, Helligkeit und Struktur in seine Ähnlichkeitsberechnung mit ein (Tabelle 1). Die Verbesserungen sind auch optisch in den Bildern ersichtlich. Die Farben des rekonstruierten Bildes sind zu denen des Eingabebildes nahezu identisch. Es entsteht keine Übersättigung der Farben und das Ergebnisbild weist keine Artefakte auf.

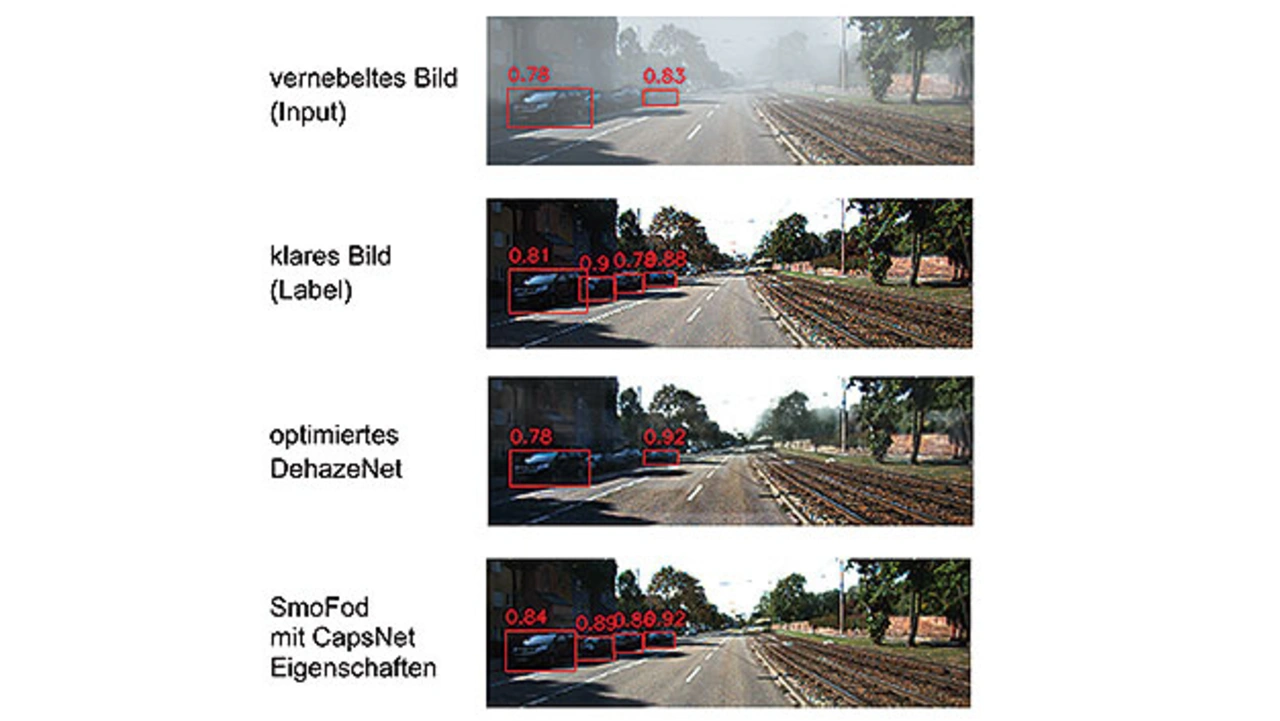

Da SmoFod als Bildaufbereitungssoftware für Fahrerassistenzsysteme gedacht ist, ist für die Beurteilung des Netzes die Leistungsfähigkeit nachgeschalteter Systeme auf den Ergebnisbildern äußerst wichtig. Mithilfe des Objektklassifikators YOLO wurden die Ergebnisse für den Anwendungsfall geprüft.

In Bild 4 werden vom YOLO erkannte Fahrzeuge mit einer roten Bounding Box und ihren entsprechenden Erkennungsraten versehen. Die schlechtesten Erkennungsraten weist das vernebelte Bild auf. Allerdings verbessern sich die Erkennungsraten durch eine Entnebelung mittels des optimierten DehazeNet kaum, und das obwohl das rekonstruierte Bild optisch deutlich klarer erscheint, als das vernebelte. Im Gegensatz dazu sind die Erkennungsraten in dem Bild, das mittels des neuartigen Autoencoders entnebelt wurde, überzeugend. Einige weisen sogar höhere Werte auf, als im Original.

Für EDAG ist KI nicht nur ein Buzzword. Das Engineering-Unternehmen verfolgt intensiv den aktuellen Stand der Technik und entwickelt seine eigene Software stetig weiter, indem neue Forschungsergebnisse erörtert, implementiert und für Kundenprojekte genutzt werden. Die Eingliederung der CapsNet-Eigenschaften in SmoFod stellt diese Vorgehensweise exemplarisch dar. Sie ermöglicht die Bereitstellung klarer Bilder für Assistenzsysteme und macht dadurch den Straßenverkehr sicherer.

Literatur

[1] Bolun Cai et al. Dehazenet: An End-to-End System for Single Image Haze Removal, CoRR, abs/1601.07661, 2015.

[2] Stephan Lenor: Model-Based Estimation of Meteorological Visibility in the Context of Automotive Camera Systems, Dissertation, Heidelberg University, 2016.

[3] vgl. KITTI Datensatz: http://www.cvlibs.net/datasets/kitti/raw data.php, letzter Zugriff: 04.10.2019

[4] Geoffrey Hinton et al.: Dynamic Routing between Capsules, 2017.

[5] Jonathan Hui blog: Understanding Dynamic Routing between Capsules (Capsule Networks), https://jhui.github.io/2017/11/03/Dynamic-Routing-Between-Capsules/, letzter Zugriff: 06.04.2021.

[6] Joseph Redmon et al. 2015: You Only Look Once: Unified, Real-Time Object Detection.

[7] Unsplash: https://unsplash.com/, letzter Zugriff: 05.05.2021.

Die Autorin

Nathalie Klingler

studierte Computational Science and Engineering im Bachelor und Informatik (mit Schwerpunkt KI) im Master an der Universität Ulm. Im Jahr 2019 startete sie ihre berufliche Karriere bei der EDAG Group in Lindau als Softwareentwicklerin. Sie war hauptverantwortlich für die KI-Komponente des KI-Prototyps des EDAG CityBots und arbeitet aktuell an weiteren Projekten im Bereich Computer Vision und Natural Language Processing.

- Nebel – und dennoch klare Sicht

- Das Capsule Neural Network