Machine Learning am Netzwerkrand

Inkrementelles vs. Batch-Lernen

Fortsetzung des Artikels von Teil 1

Vergleich der Modelle

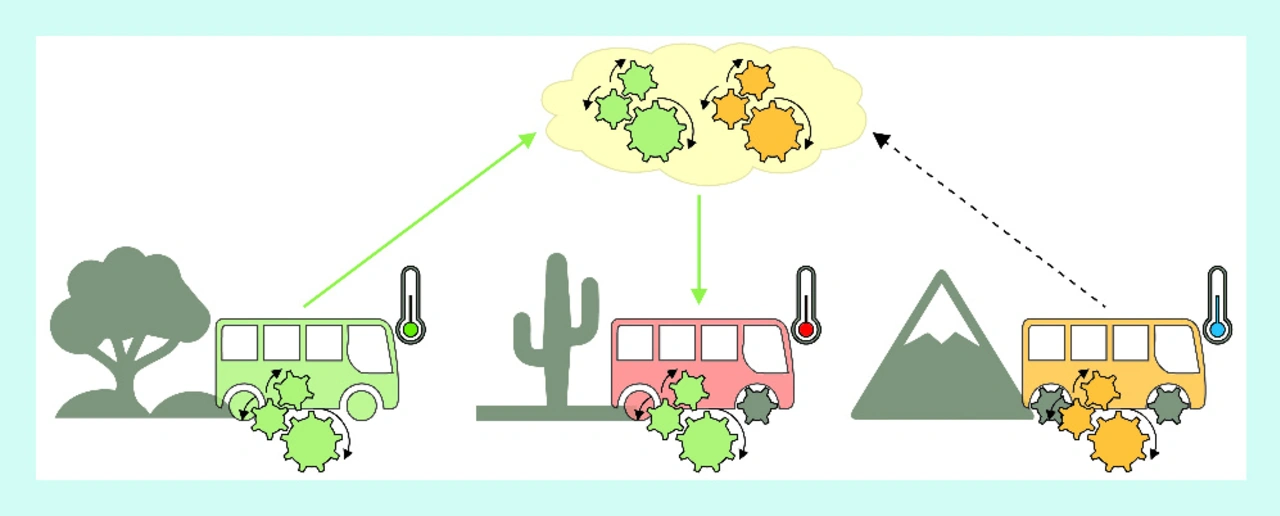

Zugriff auf die Modelle eines jeden Geräts zu haben, erleichtert nicht nur das Design genauerer und anpassungsfähiger Modelle, sondern erlaubt dem Entwickler auch einen Modellvergleich der Geräte. Da die Modelle auf Basis ihrer lokalen Daten zu erstellen sind, sind sie eine Zusammenfassung der Daten und somit auch der Geräte an sich. Um einen Vergleich anzustellen, sind also allein die Modelle in die Cloud zu übermitteln. In der Praxis erfolgt der Vergleich im Rahmen einer Analyse der Modelle, bei der verschiedene Techniken zur Anwendung kommen (Bild 5).

Die Fähigkeit, die ML-Modelle in der Cloud zu vergleichen und zu korrelieren, ermöglicht wieder neue Funktionen:

- Das Identifizieren von Ausreißern gegenüber vergleichbaren Werten, die Anomalien anzeigen. Zum Beispiel, dass ein Omnibusmotor heiß läuft oder er einen höheren Energieverbrauch hat als zuvor angenommen wurde.

- Die Analyse von übergreifenden Erkenntnissen, die aus der gesamten Flotte gewonnen wurden, in Kombination und Relation zu individuellen Erkenntnissen in Bezug auf eine bestimmte Anlage.

- Ein Gerät mit einem Modell einer vergleichbaren Einheit auszustatten und anschließend einem Feinjustieren am jeweiligen Gerät, was auch als Transfer-Lernen bezeichnet wird.

Jobangebote+ passend zum Thema

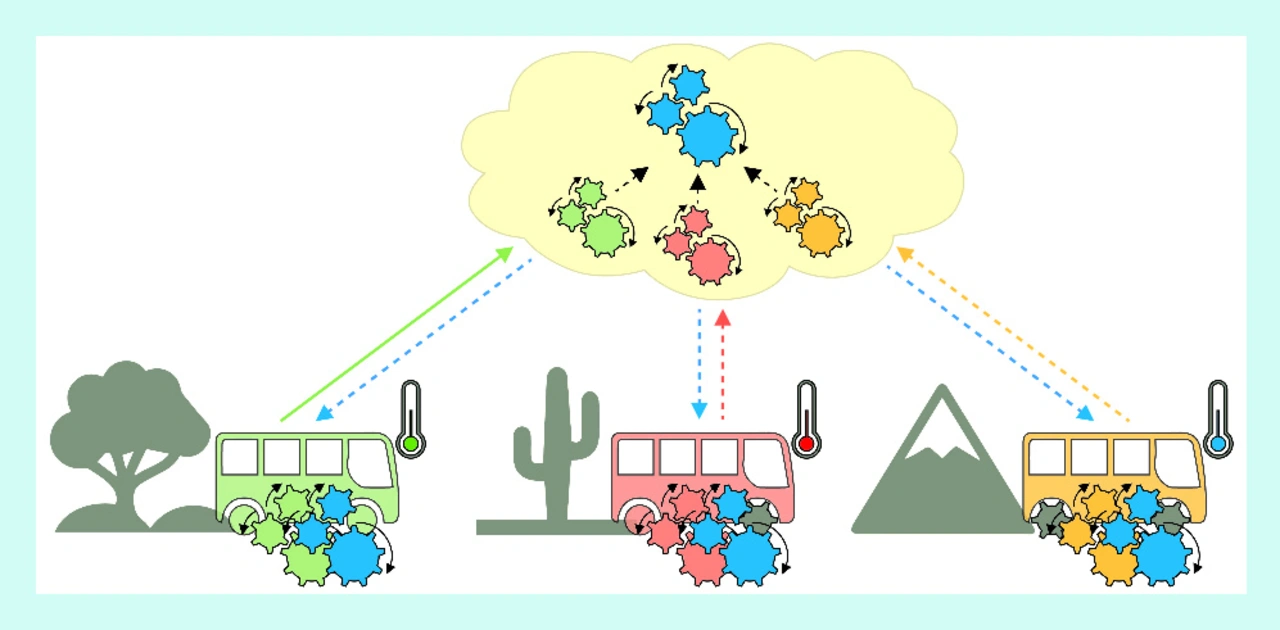

Der Nachteil des individualisierten, dezentralen Lernens ist, dass das Gerät während des Lernprozesses keine Generalisierungen machen kann oder aus Daten von anderen Geräten lernen kann, wie es beim zentralen Lernen der Fall ist. Allerdings befassen sich Wissenschaftler im Rahmen des Forschungsgebietes »Federated Learning« damit, wie dezentral trainierte Modelle voneinander lernen können (Bild 6). Der Grundgedanke hinter dem Ansatz ist der nächste Schritt, wenn der Entwickler einen Vergleich und eine Korrelation der Edge-Modelle in der Cloud in Betracht zieht: Die Modelle werden in einem neuen übergreifenden Modell, das danach wieder an jedes Gerät zu übermitteln ist, gebündelt. Anschließend kann das einzelne Gerät ganz einfach sein Edge-Modell ersetzen und das neue an die lokalen Gegebenheiten anpassen.

Die grundlegende Idee ist einfach zu erfassen, allerdings ist das tatsächliche Umsetzen des Vorhabens, also wie der Entwickler Modelle des maschinellen Lernens miteinander kombiniert, ein schwieriges und komplexes Thema. Für unterschiedliche Techniken des maschinellen Lernens kommen dabei verschiedene Lösungsansätze in Frage. Der Federated-Learning-Ansatz von Ekkono unterstützt beispielsweise das Schaffen von »Super-Modellen« für ein breites Spektrum an Verfahren für das inkrementelle maschinelle Lernen, zum Beispiel künstliche neuronale Netze, Random-Forest-Verfahren und Entscheidungsbäume. Um ein Anwenden zu sichern, ist es wichtig, dass das Federated Learning auf eine Reihe von ML-Verfahren anzuwenden ist, da es in Bezug auf das Machine Learning keine Standardanwendung gibt. Bei dem Verfahren wird eine große Zahl von Schwierigkeiten berücksichtigt.

Der Federated-Learning-Ansatz von Ekkono bietet folgende Vorteile:

- Ein Erhöhen des Lerntempos für willkürliche Anwendungen.

- Das Design eines »Super-Modells«, das Durchschnittswerte und kombinierte Lernmuster von allen Anlagen repräsentiert und als Ausgangsmodell dienen kann.

- Das Schaffen eines leistungsfähigen und umfangreichen ML-Modells für Unterkategorien von Anlagen, zum Beispiel eines allgemeinen ML-Modells für in Indien eingesetzte LKWs (kontra Skandinavien).

Die Zukunft heißt »Federated Learning«

Die Machine-Learning-Technik von Ekkono ist die Antwort auf die übergreifende Frage der sehr großen Datenvolumen, die die Sensoren im IoT erzeugen. Soll das Gerät innerhalb von Millisekunden Hochfrequenzdaten von Sensoren analysieren, ist es nicht machbar, derartige Datenmengen in die Cloud hochzuladen. An einem modernen Umspannwerk von ABB können beispielsweise Datenmengen von 5 GB/s anfallen. Auch wenn es sich realisieren ließe, solche Datenmenge hochzuladen, wäre es nicht sinnvoll, da die meisten der Daten schnell ihren Wert verlieren. Mithilfe des maschinellen Lernens am Netzwerkrand ist es jedoch in der Lage, die Hochfrequenzdaten zu verarbeiten, und das erstellte ML-Modell repräsentiert die individuellen Lernmuster der Anlage. Es ist nur einen Bruchteil so groß (einige wenige kB) wie das Rohdatenvolumen der Sensoren und gibt die real ermittelten Erkenntnisparameter aller Rohdaten wieder. Mit der Kombination und dem Vergleich mithilfe der Modellkorrelations-Maschine, hebt Ekkono die Flottenfunktion somit auf ein hohes Analyseniveau, wenn mehrere Anlagen miteinander zu kombinieren sind. Am besten funktioniert das Managen der Flottenfunktion in der Cloud.

Die Modellkorrelation ist ein neuer Ansatz für den Vergleich von ML-Modellen auf hohem Niveau, und auch das Federated Learning ist gegenwärtig ein gefragtes Forschungsthema. Google unternimmt zum Beispiel große Anstrengungen, um es im Kontext des Deep Learning zum Verarbeiten natürlicher Sprache anzuwenden. Der Ansatz von Ekkono im Bereich des Federated Learning ist für zahlreiche ML-Verfahren einsetzbar und für industrielle Anwendungen wie Predictive Maintenance konzipiert, was sich stark vom Verarbeiten natürlicher Sprache unterscheidet. Federated Learning ist also eine entscheidende Komponente beim Weiterentwickeln des Produkts von Ekkono, da es einen effizienten Ansatz für ein ressourcenintensives Feld wie ML darstellt. Darüber hinaus ist es ein nützliches Konzept, um IoT-Anwendungen mithilfe der zusätzlichen Rechenkapazitäten von vernetzten Geräten voranzubringen.

Der Autor

Rikard König (PhD) ist Mitbegründer und CTO von Ekkono Solutions. Er ist außerdem als Senior-Dozent an der Universität Borås in Schweden tätig. Dort ist er auch Mitglied einer Forschungsgruppe, die sich auf die Bereiche maschinelles Lernen und High Performance Computing spezialisiert hat. Sein Forschungsschwerpunkt liegt auf dem Entwickeln neuer oder erweiterter Algorithmen für maschinelles Lernen. Im Dezember 2016 gründete er – auf Grundlage seiner wissenschaftlichen Erfolge – zusammen mit drei weiteren Partnern das Unternehmen Ekkono Solutions.

- Inkrementelles vs. Batch-Lernen

- Vergleich der Modelle