Fahrerassistenzsysteme

Eine neue Dimension der Fahrzeugsicherheit

Fortsetzung des Artikels von Teil 1

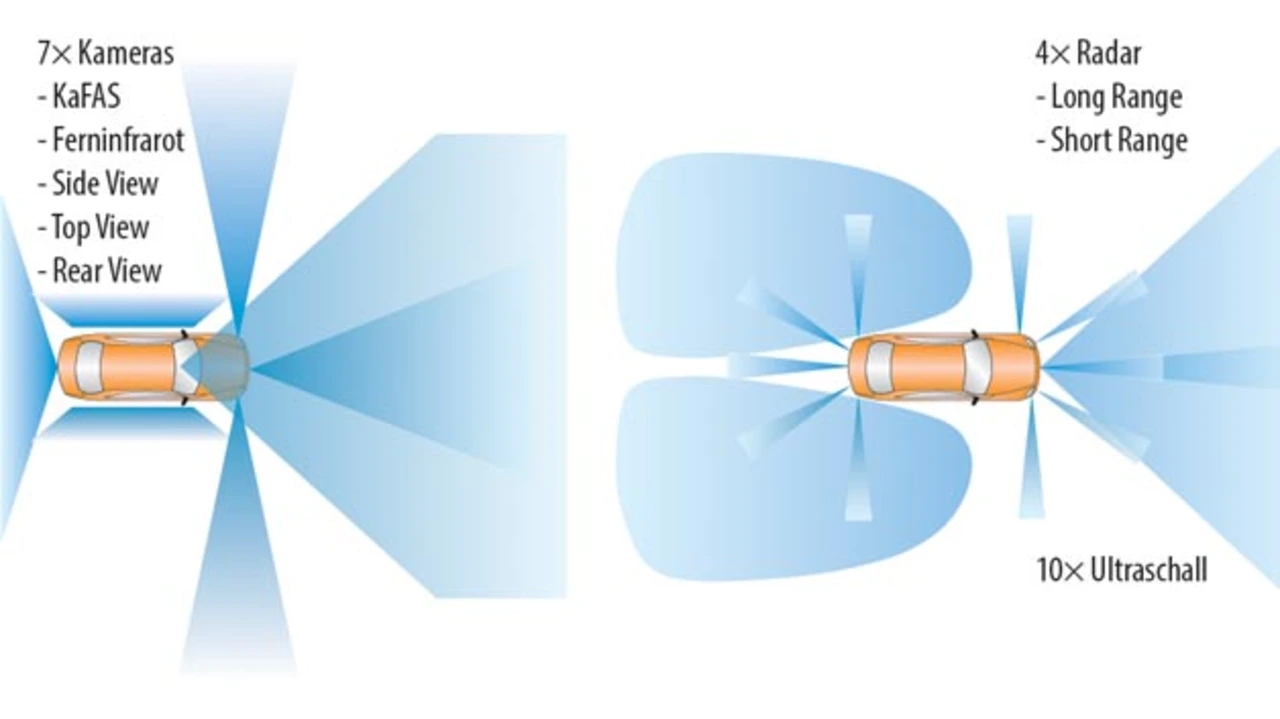

360° Runderfassung im Visier

Wie in Bild 1 dargestellt, verfügt beispielsweise die aktuelle BMW 5er Limousine über bis zu sieben Kamerasysteme, vier Radareinheiten und acht Ultraschallsensoren. Die Long- und Short-Range-Radare sowie eine Kamera dienen der Wahrnehmung von Objekten im Front- und Heckbereich. Darauf aufbauende Fahrerassistenzsysteme reichen von einer Unterstützung bei der Fahrzeuglängsführung bis hin zur Information über die aktuell zulässige Maximalgeschwindigkeit (Speed Limit Info). Mit einer Ferninfrarot-Kamera werden Wärmebilder von der Umgebung aufgenommen, um auf Personen und andere Lebewesen hinzuweisen, die sich vor dem Fahrzeug auf oder in der Nähe der Fahrbahn befinden (Night Vision). Das Einbiegen in eine Straße wird kameragestützt abgesichert (Side View). Neben dem Parkassistenten, der beim Einparken die Querführung übernimmt, wird der Fahrer durch zwei weitere Kamerasysteme unterstützt (Rear und Top View).

Jobangebote+ passend zum Thema

Das Ziel laufender Entwicklungen besteht darin, die Umfeldwahrnehmung dahingehend weiterzuentwickeln, um auf Basis der Sensordaten ein konsistentes 360°-Umfeldmodell erstellen zu können. Hierbei ist es erforderlich zu erkennen, wenn ein Objekt im Fahrzeugumfeld teilweise von dem einen Sensor und teilweise von einem anderen Sensor erfasst wird. In diesem Fall sind die Messungen der Sensoren zu assoziieren und nur eine Objekt-hypothese aufzusetzen. Die Ergebnisse der 360°-Rundumerfassung werden über eine generische Schnittstelle an die Fahrerassistenzsysteme weitergegeben.

- Eine neue Dimension der Fahrzeugsicherheit

- 360° Runderfassung im Visier

- Präventive Sicherheit für hochautomatisiertes Fahren

- Vernetzung als Schlüssel zu mehr Fahrzeugsicherheit

- Komplexe Systeme erfordern transparente Schnittstellen

- Fahrerunterstützung in anspruchsvollen Verkehrssituationen

- Die Autoren: