Lösungsorientierte Modultechnik

Was Entwickler bei der Hardwareauswahl für KI beachten sollten

KI soll Probleme lösen, die mit konventioneller Programmierung nicht oder nur schwer lösbar sind. Da sich viele Entwickler noch am Anfang ihrer Lernkurve für diese Technologie befinden, ist der notwendige Hardwareaufwand für sie schwer abzuschätzen.

Die notwendige Performance sollte möglichst skalierbar sein.

Künstliche Intelligenz und maschinelles Lernen haben eine hohe mediale Aufmerksamkeit und beflügeln so manche Fantasie. Die bekannten Produkte wie ChatGPT laufen im Internet und stützen sich auf Server-Farmen für ihre Ausführung – wird mehr Performance benötigt, schalten sich weitere Rechner zu. Diesen Luxus haben Anwendungen auf Basis von Embedded-Computertechnik nicht, sie müssen mit der gegebenen Hardware und ihrer Performance auskommen. »Für die Entwickler dieser Embedded-Systeme bedeutet es, weitere Variablen in ihre Projekte mit einzubeziehen, um im Power-/Abwärme-Budget zu bleiben und auch räumlich sowie finanziell nicht den Rahmen zu sprengen«, erklärt Stefanie Kölbl, Bereichsleiterin TQ-Embedded der TQ-Group.

Zwischen Training und Inferenz

Bei KI-basierten Projekten muss zwischen Training und Inferenz unterschieden werden, also zwischen dem Aufbau eines Modells und dessen Nutzung. Der Performance-Bedarf in der Trainingsphase ist sehr hoch, nicht verwunderlich, dass High-End-Grafikkarten zur Beschleunigung oder sogar ganze Server-Farmen zum Einsatz kommen. Für die Nutzung des trainierten Modells sind die Hardware-Anforderungen erheblich geringer; die diversen Halbleiterhersteller wollen hier mit KI-Beschleunigern punkten, die sie in die CPUs integrieren.

Dabei verfolgen sie aber unterschiedliche Strategien: Neben dedizierten Neural-Processing-Units (NPUs) kommen auch Grafikprozessoren (GPUs), erweiterte Signalprozessoren (DSPs) und parallel genutzte CPUs (heterogene Multi-Cores) zum Einsatz. »So vielfältig diese Ansätze auch wirken, unter dem Strich geht es um die Beschleunigung der Berechnung von Matrizenoperationen. Diesen Aufgaben kommen diese Lösungen auch alle nach, aber mit unterschiedlicher Rechen-Performance und Energieeffizienz«, erläutert Stefanie Kölbl. An der Performance-Spitze finden sich die GPUs mit ihren Milliarden Transistoren, was sich allerdings auch im Energiebedarf niederschlägt – für viele Embedded-Anwendungen, speziell den mobilen, ist das ein Ausschlusskriterium. Hier punkten die spezialisierten NPUs, die mit hoher Effizienz die KI-Aufgaben abarbeiten – nicht immer mit Spitzentempo, aber schnell genug für viele Inferenzaufgaben.

Jobangebote+ passend zum Thema

Performance und Effizienz

Welcher Mix aus Performance und Effizienz der richtige ist, hängt von der jeweiligen Embedded-Applikation ab. Hier heißt es also für viele Entwickler, ihre KI-Modelle mit unterschiedlichen Beschleunigeransätzen und Hardware zu evaluieren. Dieses Problem hatte Intel schon vor einigen Jahren erkannt und OpenVINO entwickelt, ein Open-Source-Software-Toolkit für die Optimierung und Bereitstellung von Deep-Learning-Modellen. Es ermöglicht, eine verbesserte Deep-Learning-Leistung für Bild-, Audio- und Sprachmodelle aus gängigen Frameworks wie TensorFlow oder PyTorch zu erstellen und an die Hardware anzupassen. Ursprünglich abgedeckt wurde die breite Intel-Produktpalette mit Multi-Core-Prozessoren, GPUs, VPUs bis hin zu FPGAs. Mittlerweile sind auch Arm/Arm64-Prozessoren hinzugekommen, und das OpenVINO-Projekt ermutigt Interessierte, das Portfolio zu erweitern.

Nicht alle Toolchains der anderen CPU-Hersteller sind genauso offen gegenüber Fremdhardware, was für viele Entwickler aber kein Nachteil ist, da sie es gewohnt sind, in dem jeweiligen Ökosystem zu agieren. Entscheidend für KI-Projekte ist dann meist der möglichst einfache Import der KI-Modelle und eine gut skalierende Hardware-Palette.

Unterschiedliche Embedded-Module

»An diesem Punkt setzen wir als TQ-Group an, um Entwickler bei ihren KI-Projekten zu unterstützen«, betont Stefanie Kölbl. »Mit Embedded-Modulen auf Basis von Intel-, NXP- und Texas-Instruments-Prozessoren erstreckt sich die Skalierbarkeit der Produktpalette auch über diverse Formfaktoren und Standards hinweg, um den Kunden den passendsten Lösungsansatz zu bieten, mit den möglichst geringsten Einschränkungen für die Projekte.«

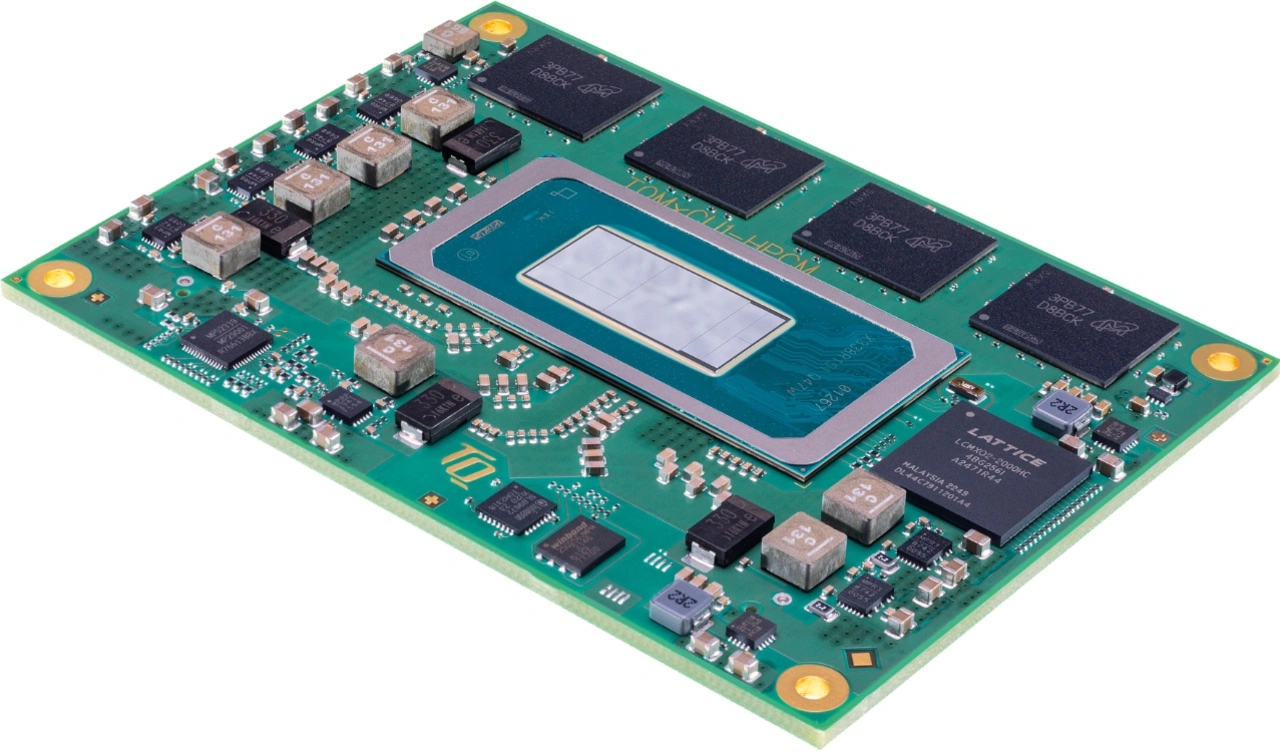

Dies zeigt sich auch in den jüngsten Erweiterungen der Produktpalette von TQ. Mit dem »TQMxCU1-HPCM« bietet das Unternehmen ein COM-HPC-Mini-Modul auf Basis von Intel-Core-Ultra-Prozessoren der Serie 100 an. Es liefert starke Leistungsdaten im Bereich KI und Grafik für Edge-Anwendungen mit einer TDP von 15 W oder 28 W. Klassische Anwendungsgebiete in Industrie, Medizintechnik, Kommunikation und Sicherheit können so KI-Technologie integrieren.

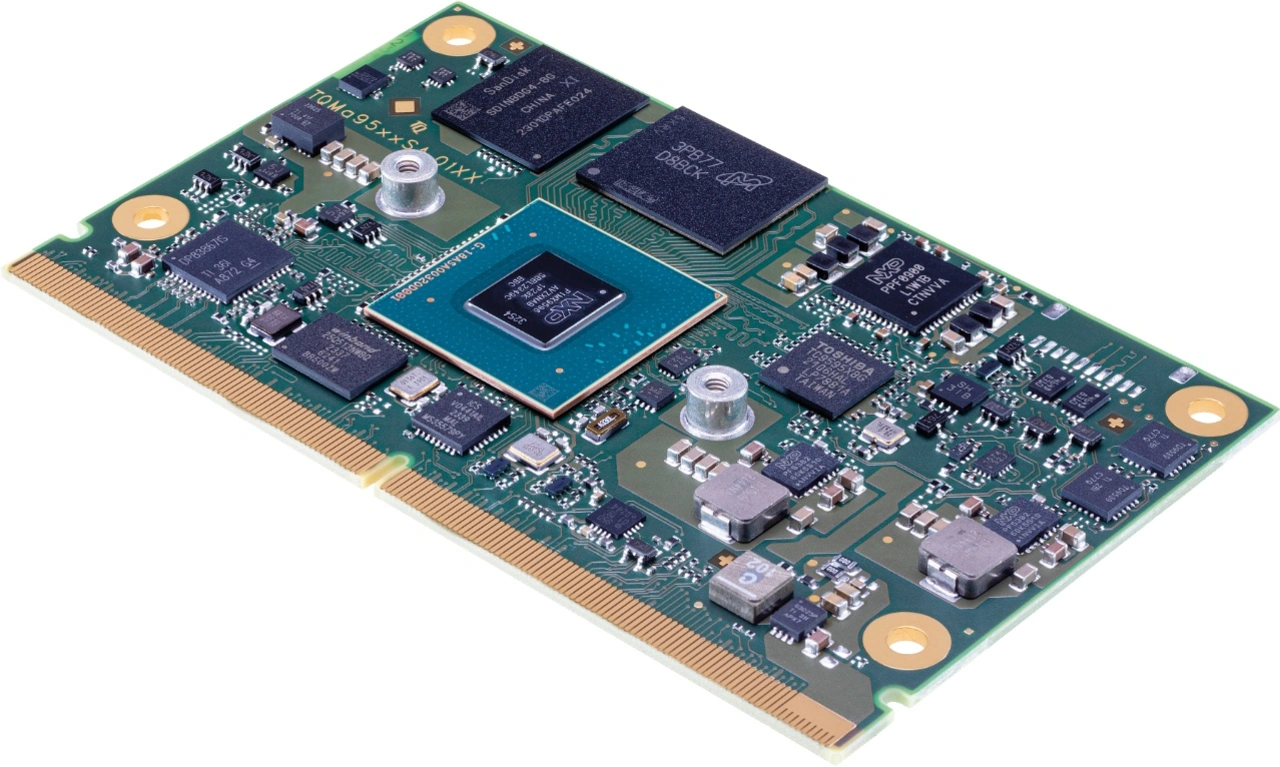

Mit einer typischen Verlustleistung von rund 6 W kommt die »TQMa95xxSA/LA«-Familie aus. Sie basiert auf dem i.MX 95 von NXP und unterstützt Entwickler mit KI-Features wie einer integrierten NPU und einer IPU (Image-Processing-Unit) bei der Umsetzung von Applikationen, bei denen künstliche Intelligenz, Machine-Learning/Vision zum Einsatz kommen soll. Eine GPU und mehrere Grafikschnittstellen stehen ebenso bereit. Für Echtzeit und Security wird die CPU von einem Cortex-M33- und Cortex-M7-Controller unterstützt. In Ausführungen als SMARC- und Lötmodul erlauben die softwarekompatiblen Module auch beim Formfaktor eine Anpassung an das Embedded-Projekt.

Das Embedded-Modul »TQMa67xx« basiert auf der Prozessorfamilie AM67xx (Quad/Dual Cortex-A53) von Texas Instruments und kommt mit 3 W bis 5 W Leistung aus. Die AM67xx-Familie bietet neben künstlicher Intelligenz und Vision-ISP auch eine 3D-GPU sowie eine Vielzahl an industriellen Schnittstellen. Als KI-Beschleuniger verwendet TI DSPs, die um den Matrix Multiply Accelerator erweitert wurden. Damit das Maximum aus diesen Prozessoren herausgeholt werden kann, setzt TQ auf proprietäre Formate für die Steck- und Lötmodule.

Wahlfreiheit für KI-Projekte

Mit seinen drei neuen Produktfamilien will TQ den Kunden nicht nur mehr Wahlfreiheit bei den Formfaktoren geben, sondern auch bei der Wahl der Toolchain, denn es hat sich gezeigt, dass nicht alle Leistungsmerkmale eins zu eins vergleichbar sind. Selbst die vermeintliche Benchmark-Angabe TOPS ist nicht immer zielführend, denn es gibt einige KI-Operationen und -Funktionen, die nicht gleich gut in den Tools implementiert sind und auch unterschiedlich gut von den Beschleunigern umgesetzt werden. »Wir hatten schon Fälle, da konnte ein KI-Modell von einer Serie mit weniger TOPS schneller verarbeitet werden als von einer anderen CPU-Serie mit mehr TOPS vom selben Hersteller. Das Evaluieren mehrerer Serien ist also sinnvoll«, berichtet Stefanie Kölbl. »Ein Aufwand, den man gerne vermeiden würde, aber aufgrund der schnellen Fortschritte der KI-Technik ist es einfach ratsam.«

Auch die Startvoraussetzungen für ein KI-Projekt können sich auf die Modulauswahl auswirken. Soll es ein Upgrade einer bestehenden Produktlinie sein oder kann man mit einem Neuprojekt beginnen? In letzterem Fall besteht die größte Wahlfreiheit, was die KI-Toolchain und die Hardware angeht. Soll hingegen eine Aufwertung eines bestehenden Produkts erfolgen, ist der Rahmen eingeschränkt, in dem man sich bewegen kann: Formfaktor, Strom- und Abwärme-Budget, die Software-Toolchain und der bestehende Quellcode der vorausgegangenen Entwicklung sind die Eckpunkte für die Weiterentwicklung. Auch hier hilft eine breite Modulpalette, die über unterschiedliche Architekturen, Standards und Leistungsaufnahmen verfügt, um ein passendes Produkt anbieten zu können. »KI braucht nicht zwingend die größtmögliche Performance. Wir unterstützen unsere Kunden deshalb mit mehr als 50 Modulserien für eine lösungsorientierte Skalierbarkeit – unabhängig von CPU-Herstellern, Formfaktoren und Toolchains«, resümiert Stefanie Kölbl.