Neue Anforderungen an Medizin-Displays

»Medical Displays wandeln sich zu integralen Schnittstellen«

In der Medizin eingesetzte Displays sind nicht mehr nur der digitale Ersatz des analogen Papiers – respektive ein Tablet, dass anstelle einer Papierkrankenakte vor dem Bett hängt.

Sie werden zu integralen Schnittstellen, die immer mehr zur Darstellung echter Volumendaten mit elektronischer Überlagerung zusätzlicher Informationen genutzt und damit zum zentralen Bindeglied für alle Arten von Patientendaten werden. Ein Ausblick.

Das enge Korsett des Begriffs Display bröckelt. »Display« wandelt sich vom Rahmen mit Scheibe als digitaler Papierersatz hin zur eigentlichen Bedeutung »to display«: dem Darstellen komplexer, visueller Informationen. Technischer Hintergrund ist freilich, dass mit immer mehr Pixel pro Fläche nun auch Darstellungen immer räumlicher realisiert werden können. Praktisch bedeutet das aber, dass sich Displays auch in medizinischen Anwendungen immer stärker zu integralen Schnittstellen entwickeln: Von Tomografen über Röntgen bis Ultraschall sind bereits heute Untersuchungsergebnisse in verschiedensten Qualitäten zum Beispiel von gesamten Organen auch räumlich oder volumetrisch verfügbar, die entsprechend dargestellt, ausgewertet und verwendet werden wollen.

Der nächste Schritt

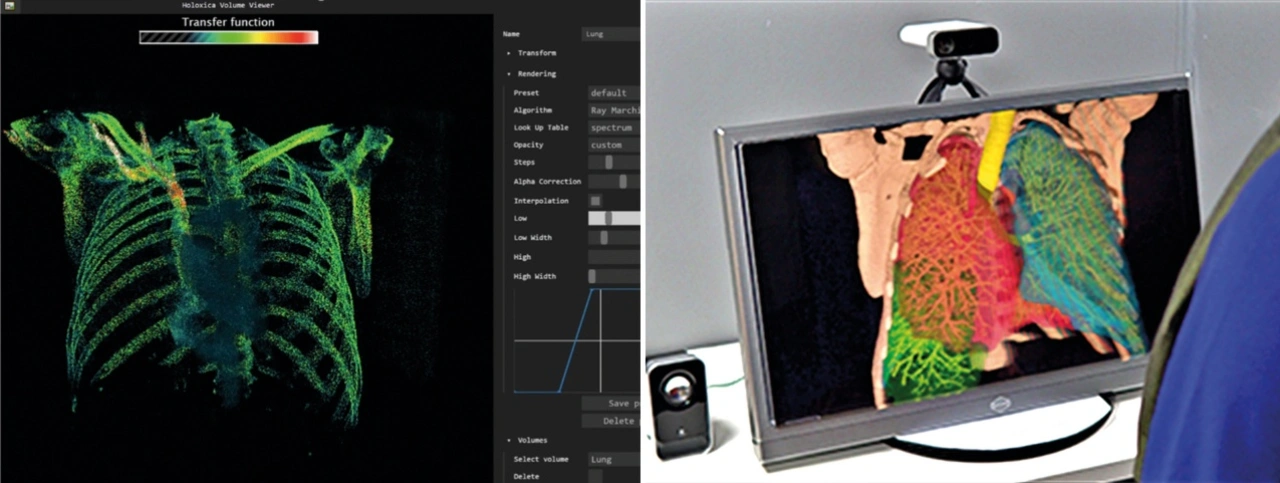

Schon seit Längerem sind technische Ansätze verfügbar, um vorhandene Daten fast dreidimensional darzustellen. Bekanntestes Beispiel, und fast schon State of the Art, ist der autostereoskope Ansatz, bei dem Ärzte mittels einer speziellen Brille operieren. Noch kann die aktuelle Technik nicht wirklich ein einheitliches Bild darstellen. Die Lösung kommt durch zwei verschiedene Bilder beziehungsweise Informationen, jeweils eine für das linke und das rechte Auge. Die Integration zur quasi räumlichen Darstellung muss das Gehirn des Betrachters übernehmen – was häufig zu Kopfschmerzen und Fehlinterpretation durch Überlastung bei den Anwendern führt.

Durch die Einflüsse und Möglichkeiten anderer wissenschaftlicher Bereiche entwickeln sich Displays jedoch weiter. Buzzwords sind Light Field Technology und natürlich Holografie. Daran arbeiten nicht nur einige große medizinische Zentren in Kontinentaleuropa, sondern auch in Deutschland. Sie machen es möglich, die erfassten Daten in ihrer Dreidimensionalität direkt weiter zu benutzen: Operationen werden mit den richtigen Werkzeugen und Situationen simuliert und trainiert. Computer-gestützte Anwendungen werden mitgenutzt, um überlagernde, zusätzliche Informationen in Echtzeit generieren zu können. Patienten werden vorab eingebunden, um ihnen die geplanten Eingriffe zu zeigen oder sie über Risiken aufzuklären. Schließlich werden die Daten auch genutzt, um 3D-Modelle von zum Beispiel individuell angepassten Knochenteilen und Gelenken als individuelle Ersatzteile zu erstellen sowie um daran in der Realität zu informieren oder zu trainieren – und sie dann auch als wirkliches persönliches Ersatzteil im Körper der Patienten zu verwenden.

Eine besonders wichtige Vision ist es, volumetrische Daten auch in großen Mengen in Echtzeit zur Verfügung stellen zu können, bei Bedarf auch über mittlere oder große Entfernungen. Gemeint ist damit nicht nur innerhalb eines Klinikkomplexes, sondern perspektivisch auch im (inter-)nationalen Austausch. Dadurch könnten beispielsweise vernetzte, dreidimensionale Geräte wie Drucker oder Roboter gemeinsam arbeiten. Vor allem aber betrifft das externe Teams, die an Operationen mittels echter volumetrischer Darstellung teilnehmen und Entscheidungen treffen oder sogar mitoperieren können. Das ist beileibe keine Utopie mehr, sondern funktioniert technisch schon heute – wenn auch weder flächendeckend noch als Standard. Beispielsweise können zusätzlich relevante Informationen zur aktuellen Patientensituation durch kontextsensitive Augmented Reality in Echtzeit geliefert werden – einen Schritt weiter sogar inline simultan in unterschiedlichen Sprachen.

Am Ende führt diese Entwicklung zu einer Kosteneinsparung durch bessere Prozesse und kürzere beziehungsweise keine Wege. Im Vordergrund steht jedoch auch mehr Qualität und Sicherheit in den Eingriffen sowie eine bessere, schnellere und risikoärmere Versorgung der Patienten.

Auswirkungen auf das Display

Die immer stärkere Auflösung des steifen Begriffs »Display« verändert also die Funktionen und Fähigkeiten der Geräte. Umgekehrt ändern wiederum die neuen Funktionen und Fähigkeiten die steife Optik von Displays. Anders formuliert: Verdichtung und Verarbeitung der Daten am Display beeinflussen und erfordern die notwendige Anpassung der technischen Infrastruktur selbst. So müssen beispielsweise komplexere Prozesse wie das Wärmemanagement der eigentlichen Elektronik speziell an der Mensch-Maschine-Schnittstelle mit viel höherer Priorität und meist völlig neu gedacht werden. Dies gilt auch für vermeintlich einfachere Dinge wie Anschlüsse beziehungsweise Schnittstellen für Vernetzung oder Energieversorgung beim Design und der Entwicklung.

Wie das letzten Endes konkret im Detail in die jeweiligen Produkte einfließt, ist Stand jetzt natürlich noch nicht vollständig vorhersehbar. Klar ist jedoch, dass durch die neue, große Informationsdichte mehr Daten pro Zeiteinheit an denselben Apparat zur Verarbeitung und schließlich zur Darstellung gesendet werden. Das hat Auswirkungen sowohl auf Designkonzepte, die zum Beispiel Baugröße und die angesprochene notwendige Kühlung berücksichtigen müssen, als auch auf das Gerät selbst, das trotz allem standardisiert und bezahlbar bleiben sollte.

Hinzu kommt ein weiter Gedanke: Es wird künftig schon schwierig genug sein, noch mehr Daten aus noch unterschiedlicheren Quellen in einer volumetrischen Anzeige sinnvoll verarbeitet darzustellen. Nun sollten diese Daten unter Umständen aber auch noch für unterschiedliche Ansichten respektive Teammitglieder zeitgleich individuell aufbereitet werden. Ein Beispiel: Daten aus verschiedenen Quellen müssen für ein OP-Team zusammengeführt und wie am echten OP-Tisch auch aus unterschiedlichen Blickwinkeln dargestellt werden. Diese Darstellung soll außerdem pro Spezialist mit zusätzlichen Informationen »augmented«, gegebenenfalls in unterschiedlichen Sprachen und in unterschiedlichen Ländern ohne Zeitversatz aufgewertet werden und individuell in der Darstellung manipulierbar sein. Ebenfalls denkbar ist die besondere, individuelle Hervorhebung einzelner Teilinformationen für Teammitglieder mit speziellem Einsatzgebiet, unterstützt durch KI-basierte Assistenzsysteme.

Das bedeutet tatsächlich eine große Veränderung im Datenmanagement. Hinter all den potenziellen Möglichkeiten steckt eine enorme Rechenleistung, die aktuell (noch) nicht wirklich verfügbar ist und daher in ihrer echten physischen Größe auch nicht in das Design eingeplant werden kann. Ebenfalls noch zu definieren sind technische Standards und Schnittstellen, damit Geräte vor allem ihre Daten gegenseitig lesen und nutzen können. Dabei geht es nicht um einen internationalen Standard per Saldo, sondern nur um einen technischen Standard, der die Kommunikation ermöglicht.

Fazit

Die Displays der nächsten Generation verbinden die Daten mehrerer medizinischer Geräte in einer Darstellung. Ob neuartige Ultraschallgeräte, Tomografen oder auch Röntgensysteme: Displays tragen die Informationen zusammen und erzeugen die Visualisierung. Noch ist diese 2D+ beziehungsweise stereoskop, wird aber eher kurz- als langfristig tatsächlich volumetrisch sein.

Displays werden vom puren digitalen Anzeigenblatt zum integralen 3D-Anzeigemedium, das vom Befund, über Analyse bis zum Training und Patientenaufklärung sowie Life-Unterstützung durch Augmented Reality beziehungsweise überlagernde Informationen sinnvoll zusammenhängend dreidimensional visualisiert – mit dem Anspruch der Echtzeitfähigkeit. Das reduziert das Risiko für alle Beteiligte und beschleunigt die Eingriffszeit, was wiederum bessere Heilungschancen und kürzere Aufenthaltszeiten im Krankenhaus bewirkt.

Möglich wird dieser Entwicklungssprung durch das Aufbrechen einer Begriffsbedeutung: Display als Medium zur Informationsdarstellung, nicht als Kasten. Letzten Endes wird damit die Funktion des Mediums »Display« und nicht das Gerät zur eigentlichen Schnittstelle. Zentrales Element bleibt aber, dass die visuelle Kommunikation in den Mittelpunkt der Eigenschaft eines Displays rückt – eine wirkliche HMI (Mensch-Maschine-Schnittstelle). Neu ist, dass nicht mehr das Display als Anzeigemedium angibt, was damit gemacht werden kann, sondern dass die Möglichkeiten Informationen darzustellen, die Darstellungsmedien und deren Entwicklung beeinflussen.

Bis das flächendeckend so weit ist, vergeht Zeit. Bis dahin könnten dann auch Begleitprobleme gelöst werden: Zum Beispiel wie die enormen individuellen Datenmengen zeitgleich überall verfügbar werden und welche technischen Standards auch für die Kontrolle und Sicherheit dieser Daten geschaffen werden müssen.

Autor: Klaus Wammes, Geschäftsführer Wammes & Partner GmbH