Mit der Maschine sprechen #####

Fortsetzung des Artikels von Teil 2

Mit der Maschine sprechen

Die Vorteile für den Anwender

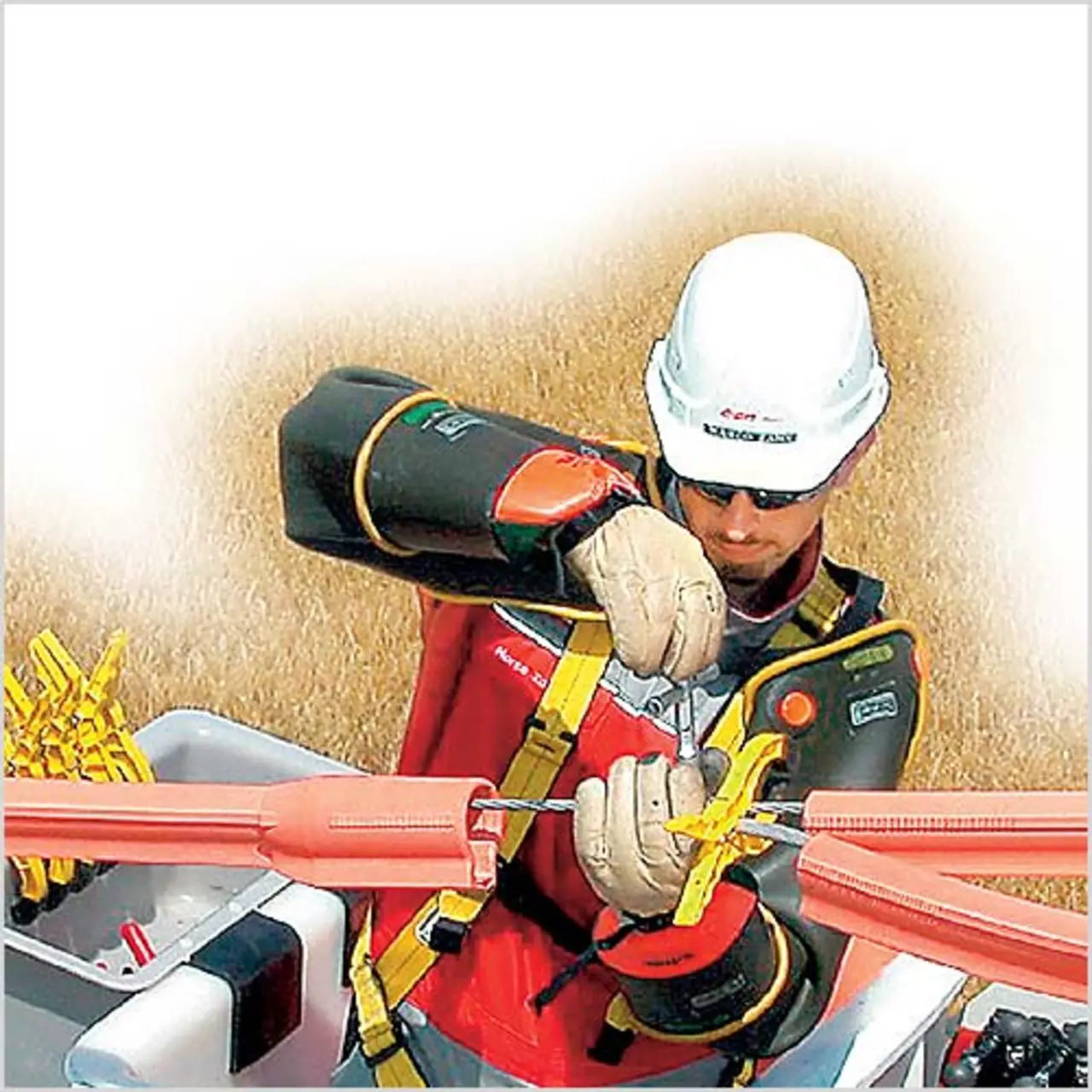

Ein wesentlicher Vorteil, der sich durch den Einsatz von Spracherkennung im Maschinen- und Anlagenbau ergibt, besteht darin, dass der Werker seine beiden Händen frei hat und sich damit besser auf seine Hauptaufgaben konzentrieren kann. Zudem sind diese Systeme für die mobile Dateneingabe prädestiniert und können damit insbesondere im Bereich der Beschaffungs-, Produktions- und Vertriebslogistik zu einer Reduzierung von Totzeiten durch Wegfall von Wegezeiten beitragen. Auch im Zusammenhang mit der Instandhaltung ergeben sich interessante Perspektiven durch die sprachunterstüzte Bereitstellung von Expertenwissen: zum Beispiel in punkto Störungsdiagnose und der gezielten Zuordnung von störungsverursachenden Komponenten, der zeitnahen Rückführung von Fehlerursachen und Abgleich mit realen „Lebenslauf“-Informationen oder auch mit Blick auf die Optimierung der vorbeugenden Instandhaltung durch Bereitstellung von Realdaten. Damit nicht genug: Denkbar ist durchaus auch eine Steuerung von Maschinen und Anlagen per Sprache, zum Beispiel im Rahmen von Einrichtprozessen wie etwa der Anpassungen von CNC-Steuerbefehlen oder einer integrierten Code-Prüfung über entsprechende Befehle. Ein weiteres Beispiel ist die Unterstützung des Rüstprozesses bei Maschinen über eine sprachgeführte Anleitung der Werker.

Eine für die Akzeptanz dieser Technologie in der Industrie wesentliche Voraussetzung ist die Sprecherunabhängigkeit. Das heißt: Die Systeme müssen in der Lage sein, sowohl unterschiedliche Personen als auch diverse Dialekte zu erkennen, und darüber hinaus verschiedene Sprachen beherrschen. Betrachtet man allein die Wortvielfalt einer Verneinung im Deutschen, so gibt es diesbezüglich schon beim Dialekt gravierende umgangssprachliche Abweichungen, mit denen das Spracherkennungs-System zurechtkommen muss. Beispiel Schwaben: Die Antwort „nein“ hört sich dort von Region zu Region zum Teil höchst unterschiedlich an – von „ne“, „na“, über „nai“ oder auch „nei“ bis hin zu „idda“! Nicht zuletzt muss eine Authentifizierung der für die Maschine oder Anlage berechtigten Bediener möglich sein.

Grundsätzlich gibt es zwei Verfahren der Spracherkennung:

- die Sprecher-unabhängige Spracherkennung

- sowie die Sprecher-abhängige Spracherkennung („Diktiersysteme“).

Sprecher-abhängige Systeme müssen aufwendig trainiert werden. Aufgrund der Sprechergebundenheit ist eine Erkennung von unterschiedlichen Sprechweisen, Stimmlagen und auch verschiedenen Sprachen nicht möglich. Diese Systeme sind eindeutig auf eine Person oder einen Benutzer festgeschrieben. Ein wesentlicher Vorteil dieser Systeme ist jedoch die hohe Erkennungsquote, die die ASR-Engine zurückliefert: Dies ist bei den meisten Systemen auf ein personifiziertes Stimmfrequenz-Muster zurückzuführen. Sprecher-abhängige Systeme sind zudem in ihrem Wortschatz nicht begrenzt, da anhand des Trainierens ein Stimmmuster für die Erkennung hinterlegt wird. Somit hat ein trainiertes System keine Schwierigkeiten „Freund“ und „freundlich“ zu erkennen und zu unterscheiden.

Hingegen kennt ein untrainiertes System nur das, was ihm an Know-how im Vokabular mitgeliefert wird. Eine freie Spracherkennung im sprecherunabhängigen Umfeld gibt es bis dato nicht. Ergo ist bei der Entwicklung von Sprachdialogen nach diesem Verfahren exakt das Einsatzgebiet und deren vorherrschende Dialogstruktur zu analysieren und dementsprechend zu konzeptionieren. Mit anderen Worten: Sprecher-unabhängige Systeme sind nur quasi intelligent, da sie nur das erkennbar machen, was ihnen bekannt ist. Von Vorteil bei den untrainierten Systemen ist, dass hier auch alternative Sprachen wie Englisch, Spanisch, Französisch oder auch Russisch möglich sind. Einschränkungen oder Probleme in der Nutzer- Akzeptanz durch sprachliche Unterschiede in der Aussprache, wie sie in den vielen Dialekten zu finden sind, sind heutzutage kein Problem mehr. Dialekte stellen lediglich Eingabe-Alternativen zu bereits definierten Funktions- oder Füllwörtern dar, die im Endeffekt dasselbe Kommando aufrufen.

- Mit der Maschine sprechen #####

- Mit der Maschine sprechen

- Mit der Maschine sprechen

- Mit der Maschine sprechen

- Mit der Maschine sprechen