Künstliche Intelligenz

Aktuelles aus der Forschung

Das Trendthema KI hat Wissenschaft und Technik fest im Griff. Von Sensoren für Windräder über neue Anbaumethoden für Zuckerrüben bis hin zur erklärbaren KI. Wir fassen für Sie aktuelle News aus der KI-Forschung zusammen.

Im Projekt »SENSORITHM Rhein-Main« entwickeln die Forschenden der Goethe-Universität Frankfurt verschiedene, selbstlernende Sensorsysteme auf Basis von Methoden der künstlichen Intelligenz (KI). Sie sollen es zukünftig erlauben, die Betriebszeiten von Windkrafträdern so zu optimieren, dass Fledermausarten und bestimmte Vogelarten wie der Rote Milan nicht gefährdet werden. Außerdem könnten sich die Windräder abschalten, wenn es eine erhöhte Flugaktivität gibt. So lässt sich die Stromerzeugung aus Windenergie besser mit dem Artenschutz vereinbaren. Als zweite Säule entwickeln die Wissenschaftler:innen im Projekt neue Sensoren und Algorithmen zur technischen Überwachung von Windrädern – die Technik kann jedoch ebenso bei anderen Industrieanlagen zum Einsatz kommen. Die neuen Sensoren sollen an verschiedenen realen Testobjekten erprobt werden.

Supercomputer für Ilmenau

An der TU Ilmenau werden eine Reihe von Projekten durchgeführt, die menschliches Denken und Lernen auf Computersysteme übertragen. Hierbei profitieren die Ilmenauer Forschenden künftig von einem leistungsstarken High-Performance-Computer. Das Transferprojekt »thuringian AI« – kurz thurAI – erforscht die drei Bereiche Gesundheitswesen und Medizintechnik, Produktions- und Qualitätssicherung sowie Smart Cities. Um die Projekte durchführen zu können, geht im Rechenzentrum der TU Ilmenau demnächst ein GPU Cluster in Betrieb. Mit dem parallelen Verarbeiten großer Datenmengen ermöglicht der Cluster anspruchsvolle Lernprozesse moderner KI-Techniken. Außerdem wird das Trainieren von KI-Algorithmen erheblich beschleunigt. So ermöglicht der Computer den Einsatz moderner Deep-Learning-Verfahren und verschafft der Universität und ihren Partnern Zugang zu hohen Datenverarbeitungsraten.

Jobangebote+ passend zum Thema

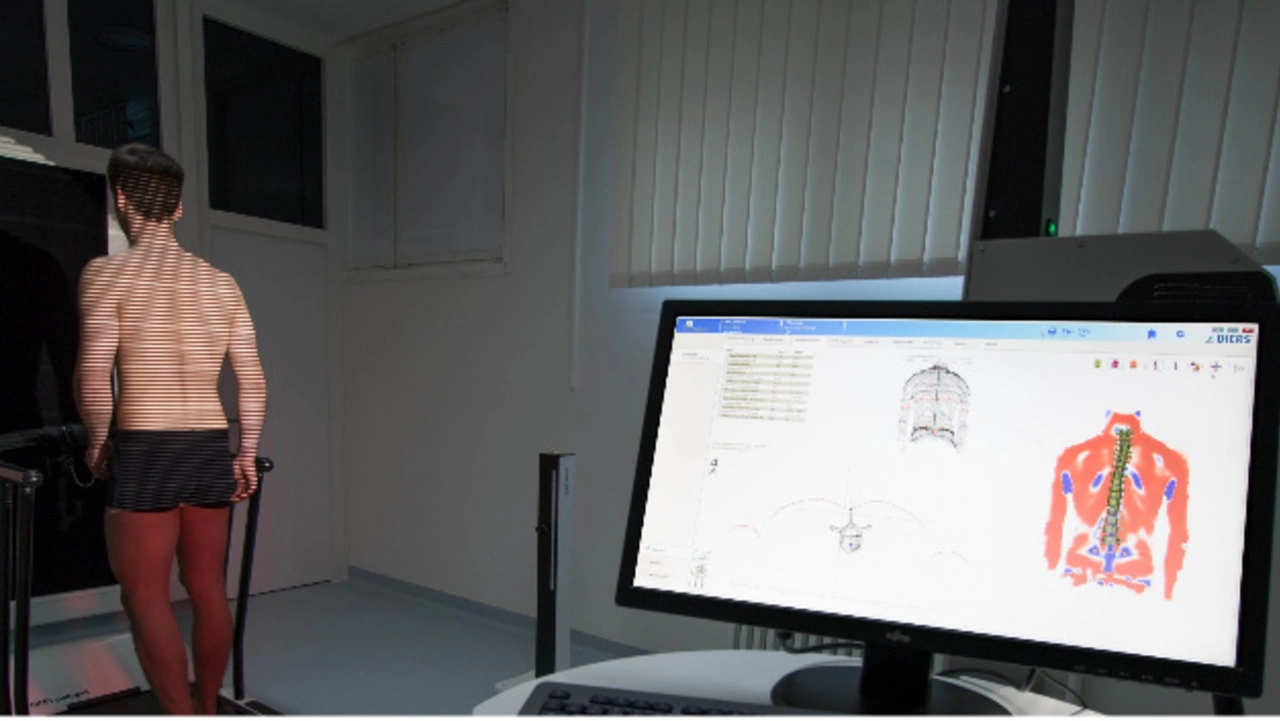

Ursache von Rückenschmerzen erkennen

Ein Forscherteam der TU Kaiserslautern und verschiedenen Partnern arbeitet an einem Verfahren, mit dem sich Fehlstellungen des Rückens besser beobachten lassen. Zum Einsatz kommen hierbei KI-Verfahren. Sie helfen dabei, die Wirbelsäule individuell zu analysieren. Mit dem Verfahren sollen die Ursachen der Schmerzen klar definiert werden. Das Team setzt dabei auf eine in der Praxis bereits gut erprobte und verbreitete Diagnosetechnik. Mit einem Projektor und einer Kameraeinheit scannt das Team den Rücken und projiziert hierbei ein Lichtgitter. Mittels der sogenannten Rasterstereographie kann so ein individuelles Modell der Wirbelsäule berechnet werden. Neu bei der Methode ist der Einsatz von Verfahren der KI und des maschinellen Lernens. So lernt das System mit den gewonnenen Daten permanent hinzu. Das kann der Medizin künftig helfen, zum Beispiel Fehlstellungen besser aufzuspüren und personalisierte Diagnosen zu treffen, die eine individuelle Therapie ermöglichen.

Neue Anbaumethoden für Zuckerrüben

Das Verbundprojekt »zUCKERrübe« will einen nachhaltigen und pestizidfreien Anbau von Feldfrüchten in der Uckermark ermöglichen. Als Beispiel dienen Zuckerrüben. Im Projekt untersuchen Wissenschaftler:innen der Hochschule Eberswalde Feldroboter, UAS-Technik und KI-Verfahren sowie das Zusammenspiel aller Komponenten. Zentrale Aufgabe ist das Entwickeln einer neuen Unkrautregulierungstechnik, um den Anbau von Zuckerrüben in die Fruchtfolge der nachhaltigen Landwirtschaft zu integrieren. Zusätzlich soll es möglich sein, die neue Technik auch auf andere Pflanzenarten zu übertragen. In der Entwicklungsphase des Projektes spielt die enge Zusammenarbeit mit Betrieben und den regionalen Verarbeitern eine große Rolle, um die Praxistauglichkeit zu gewährleisten. Konkret sollen die Forschenden im Projekt eine KI-basierte Bildanalyse auf einer ressourcenarmen Hardware-Plattform entwickeln. So ist es möglich, den Unkrautbefall zu bestimmen und den Hackroboter zu orten. Hierzu kommen Hardware-Beschleuniger zum Einsatz.

Ziel: Erklärbare KI

Die Deutsche Forschungsgemeinschaft (DFG) richtet einen neuen Sonderforschungsbereich zum Thema »Erklärbarkeit von KI« an den Universitäten Paderborn und Bielefeld ein. Ziel ist es, die Mensch-Maschine-Interaktion zu verbessern, das Verständnis von Algorithmen in den Mittelpunkt zu stellen und dieses als Produkt eines multimodalen Erklärprozesses zu untersuchen. »Bürgerinnen und Bürger haben ein Recht darauf, dass algorithmische Entscheidungen transparent gemacht werden. Das Ziel, Algorithmen zugänglich zu machen, ist Kern der sogenannten eXplainable Artificial Intelligence (XAI), bei der Transparenz, Interpretier- und Erklärbarkeit als gewünschte Ergebnisse im Mittelpunkt stehen«, sagt Prof. Dr. Katharina Rohlfing. Gerade bei Vorhersagen im Bereich der Medizin oder der Rechtsprechung sei es nötig, die maschinengesteuerte Entscheidungsfindung nachzuvollziehen.

KI beherrschen

Künstliche Intelligenz hat meistens Black-Box-Charakter. Um den jeweiligen Lösungsweg zu erklären, gibt es spezielle Software. Eine Studie des Fraunhofer IPA verglich und bewertete unterschiedliche Methoden, die maschinelle Lernverfahren erklärbar machen.

Nutzer wollen insbesondere bei kritischen Anwendungen verstehen, wie eine Entscheidung zustande kommt: Warum wurde das Werkstück als fehlerhaft aussortiert? Wodurch wird der Verschleiß meiner Maschine verursacht? Nur so sind Verbesserungen möglich, die zunehmend auch die Sicherheit betreffen. Experten des Fraunhofer IPA verglichen neun gängige Erklärungsverfahren – wie LIME, SHAP oder Layer-Wise Relevance Propagation – miteinander und bewerteten sie mithilfe von beispielhaften Anwendungen. Hierbei zählten vor allem drei Kriterien:

- Stabilität: Bei gleicher Aufgabenstellung soll das Programm stets dieselbe Erklärung liefern.

- Konsistenz: Gleichzeitig sollten nur geringfügig unterschiedliche Eingabedaten auch ähnliche Erklärungen erhalten.

- Wiedergabetreue: Besonders wichtig ist, dass Erklärungen tatsächlich das Verhalten des KI-Modells abbilden.

Fazit der Studie: Alle untersuchten Erklärungsmethoden haben sich als brauchbar erwiesen. Doch es gibt nicht die eine perfekte Methode. Große Unterschiede gibt es beispielsweise bei der Laufzeit, die ein Verfahren benötigt. Die Auswahl der besten Software ist zudem maßgeblich von der jeweiligen Aufgabenstellung abhängig.